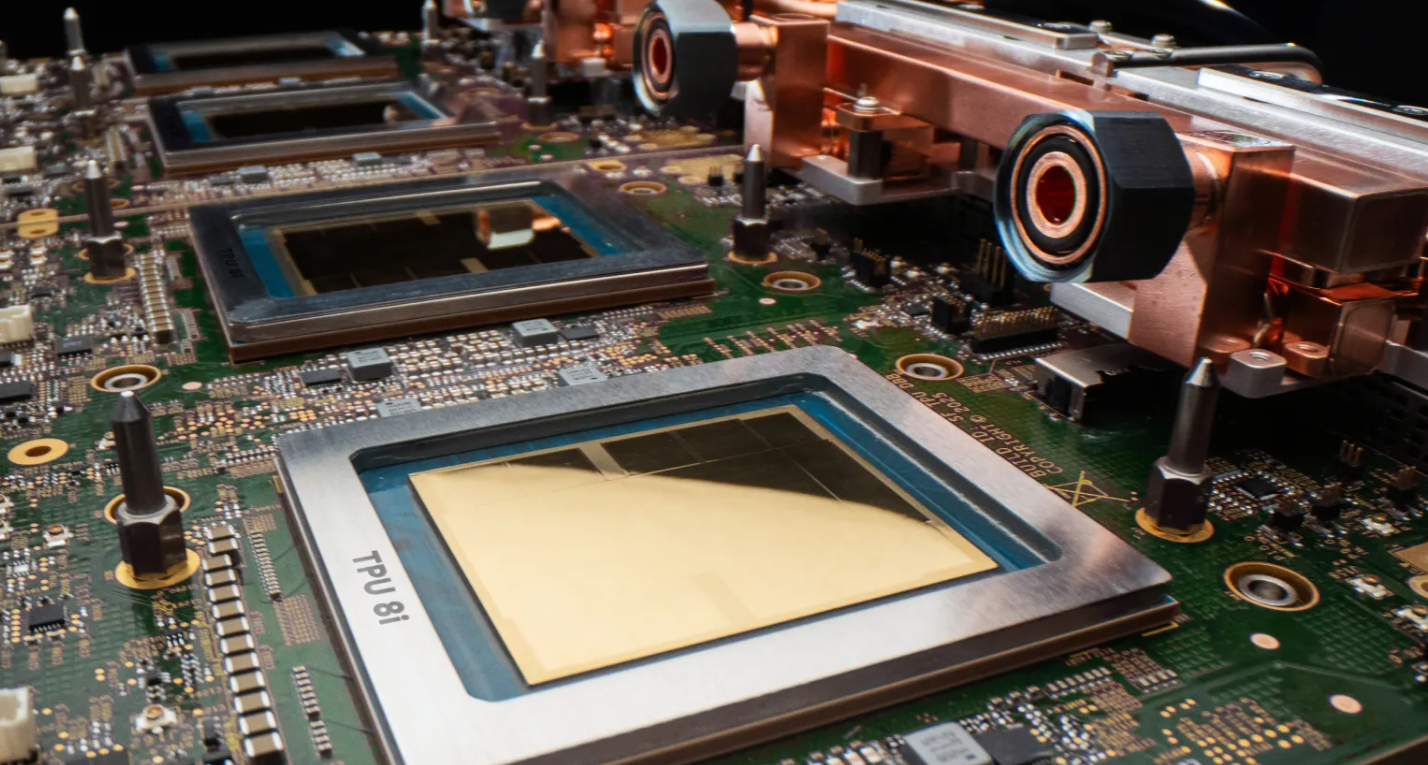

En Google Cloud Next ’26, Google presentó TPU 8t y 8i con arquitecturas separadas para entrenamiento e inferencia de IA agéntica.

En el marco de Google Cloud Next ’26, Google Cloud presentó su octava generación de Tensor Processing Units (TPU) con dos arquitecturas diferenciadas. TPU 8t fue diseñada para entrenamiento a gran escala, mientras TPU 8i apunta a inferencia de baja latencia, razonamiento y serving, en una separación de funciones que responde a las nuevas exigencias de la infraestructura para IA agéntica.

Este procesador fue concebido para acelerar el preentrenamiento de modelos de frontera y reducir ciclos de desarrollo que antes podían tomar meses. Según Google, un superpod de TPU 8t puede escalar hasta 9.600 chips, integrar 2 petabytes de memoria compartida de alto ancho de banda y entregar 121 ExaFlops de cómputo, con una mejora cercana a 3 veces por pod frente a la generación previa.

Además del volumen bruto de cómputo, la gran G reforzó la alimentación de datos y la escalabilidad del sistema. TPU 8t incorpora acceso a almacenamiento hasta 10 veces más rápido mediante TPUDirect y puede apoyarse en Virgo Network para escalar con comportamiento casi lineal, incluso en configuraciones lógicas de gran tamaño.

La TPU 8i está diseñada para post-training, serving y razonamiento concurrente, con foco en reducir tiempos de espera durante la ejecución. El gigante tecnológico señala que cada chip combina 288 GB de memoria HBM con 384 MB de SRAM en chip, mientras la configuración completa puede escalar hasta 1.152 chips por pod, con 331,8 TB de HBM total y 11,6 ExaFlops en precisión FP8.

En esta arquitectura, Google dejó de apoyarse en la topología 3D torus de TPU 8t y adoptó Boardfly, una red jerárquica pensada para cargas con comunicación intensiva. No se trata de una malla puramente óptica de extremo a extremo. El diseño parte desde bloques de cuatro chips, agrupa ocho boards y luego conecta 36 grupos mediante Optical Circuit Switches, con el objetivo de reducir saltos y latencia.

El diagrama muestra que Boardfly ordena TPU 8i mediante una jerarquía de interconexión que escala desde bloques de cuatro chips hasta el pod completo. Esa arquitectura reduce la distancia de comunicación frente a la topología toroidal tradicional y favorece cargas como MoE y razonamiento, donde el intercambio de datos entre chips es decisivo para el rendimiento.

En palabras simples, Boardfly es como un edificio de oficinas de varios pisos, con ascensores directos y escaleras rápidas entre niveles clave, en vez de un laberinto interminable de pasillos, como ocurre en una red torus 3D. Así reduce los “saltos” entre chips de 16 a 7 y acelera el flujo de datos en tareas intensivas.

La densidad de cómputo de ambas plataformas exige un soporte térmico más agresivo que el enfriamiento por aire convencional. La firma indica que TPU 8t y TPU 8i están refrigeradas por su tecnología de refrigeración líquida de cuarta generación, junto con gestión dinámica de energía, para sostener mayores densidades y mejorar la eficiencia del sistema completo.

La imagen anterior corresponde a la unidad de distribución de enfriamiento. Este componente forma parte de una estrategia más amplia en la que el ecosistema, la red, el almacenamiento, los hosts Axion y el centro de datos fueron co-diseñados como una sola pila, en vez de tratarse como piezas aisladas.

En conjunto, la separación entre TPU 8t y TPU 8i responde a un cambio de fondo en la infraestructura de IA. Google plantea que entrenamiento, serving e inferencia agéntica ya no comparten los mismos cuellos de botella, por lo que requieren arquitecturas distintas para sostener rendimiento, eficiencia energética y escalabilidad en producción.

La corrección conceptual más importante es esta: 8t y 8i no son “módulos” de un mismo chip, sino dos plataformas diferentes, y en 8i la topología Boardfly no reemplaza todo por enlaces ópticos directos, sino por una jerarquía mixta de interconexiones internas, boards, grupos y conmutación óptica entre grupos.