OpenAI publicó recientemente un extenso informe que documenta sus acciones para interrumpir las campañas de actores de amenazas que intentan abusar de sus modelos de lenguaje para estafar. Dentro de este reporte de ciberseguridad, nos enfocaremos en dos esquemas de fraude diseñados de manera específica para engañar a los consumidores y robar dinero:

- Ell casos Date Bait

- False Witness,

La firma detrás de ChatGPT detectó y bloqueó varias cuentas que estaban usando sus modelos de lenguaje para automatizar estafas financieras contra personas comunes en mensajería y redes sociales. En la práctica, esto permitía enviar mensajes y sostener conversaciones de forma masiva para engañar a más usuarios.

Según la compañía, estas redes mezclaban operadores humanos con chatbots para crear perfiles falsos y ganarse la confianza de las víctimas. Una vez que la relación estaba establecida, avanzaban hacia el objetivo final, quitarles dinero.

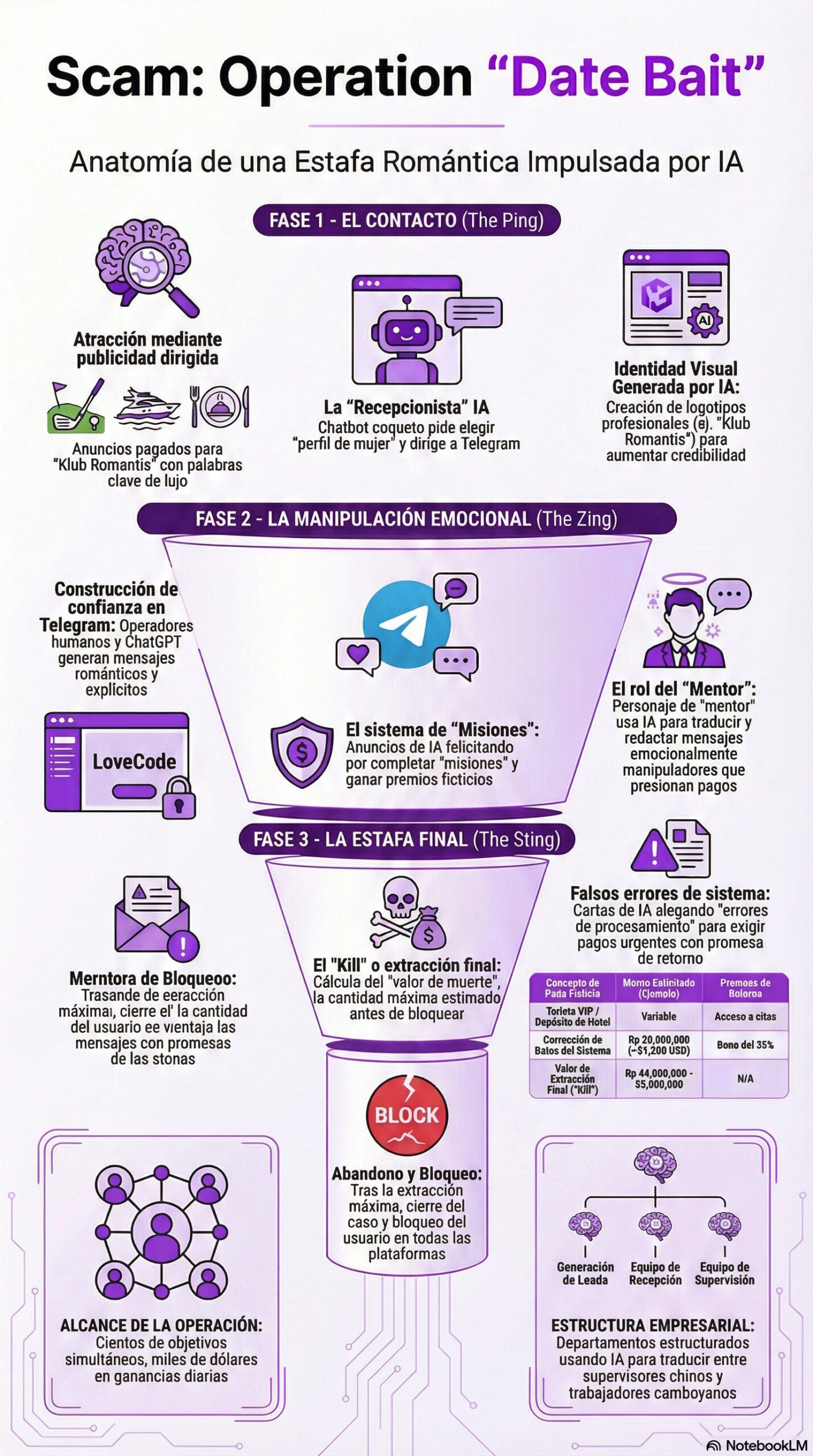

Date Bait: El engaño de las agencias de citas virtuales y las tareas remuneradas

Una de las redes desarticuladas operaba desde Camboya y para estafar utilizaba la interfaz de programación de aplicaciones de OpenAI para alimentar un sistema automatizado de estafas sentimentales. Los atacantes perfilaban a sus víctimas mediante anuncios en redes sociales y luego las derivaban a Telegram, donde un programa de computadora generaba mensajes con lenguaje romántico y sexualmente explícito para convencerlas de realizar transferencias bancarias bajo la promesa de desbloquear beneficios VIP.

De acuerdo con el reporte de OpenAI, los estafadores usaban elementos falsos como:

- Una imagen de una recepcionista falsa para la plataforma de citas “LoveCode”, creada por un estafador utilizando ChatGPT.

- Copia de una carta compartida con ChatGPT por un estafador, en la que se le indica a una víctima que debe pagar Rp 20.500.000 (US$12.000) para corregir un supuesto error de procesamiento de datos en el sistema Love Code, pero que recibirá un “bono” del 35% equivalente a Rp 39.860.000.

Este método de suplantación funciona así:

- La víctima recibe mensajes personalizados, como si fueran cartas de amor escritas por alguien real.

- El sistema está programado para responder según sus emociones y reacciones.

- La persona cree que construye una relación auténtica al otro lado de la conversación.

- En realidad, interactúa con un mecanismo automatizado, un LLM.

- El objetivo final es ganarse su confianza para vaciar su cuenta bancaria, sin necesidad de intervención humana constante.

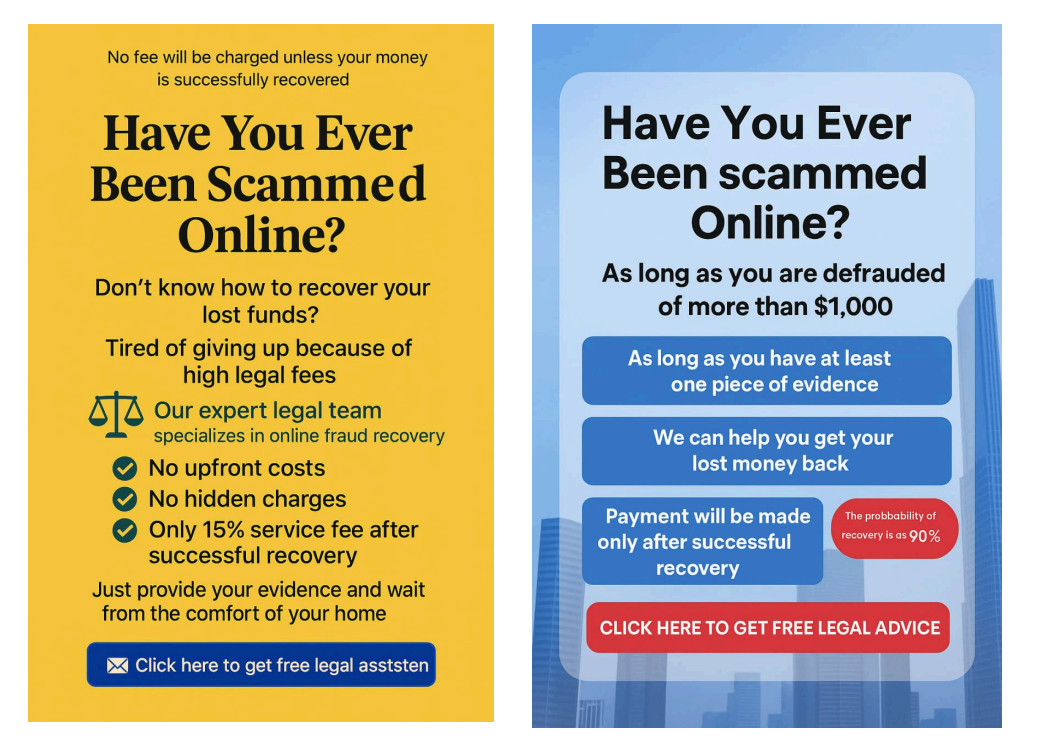

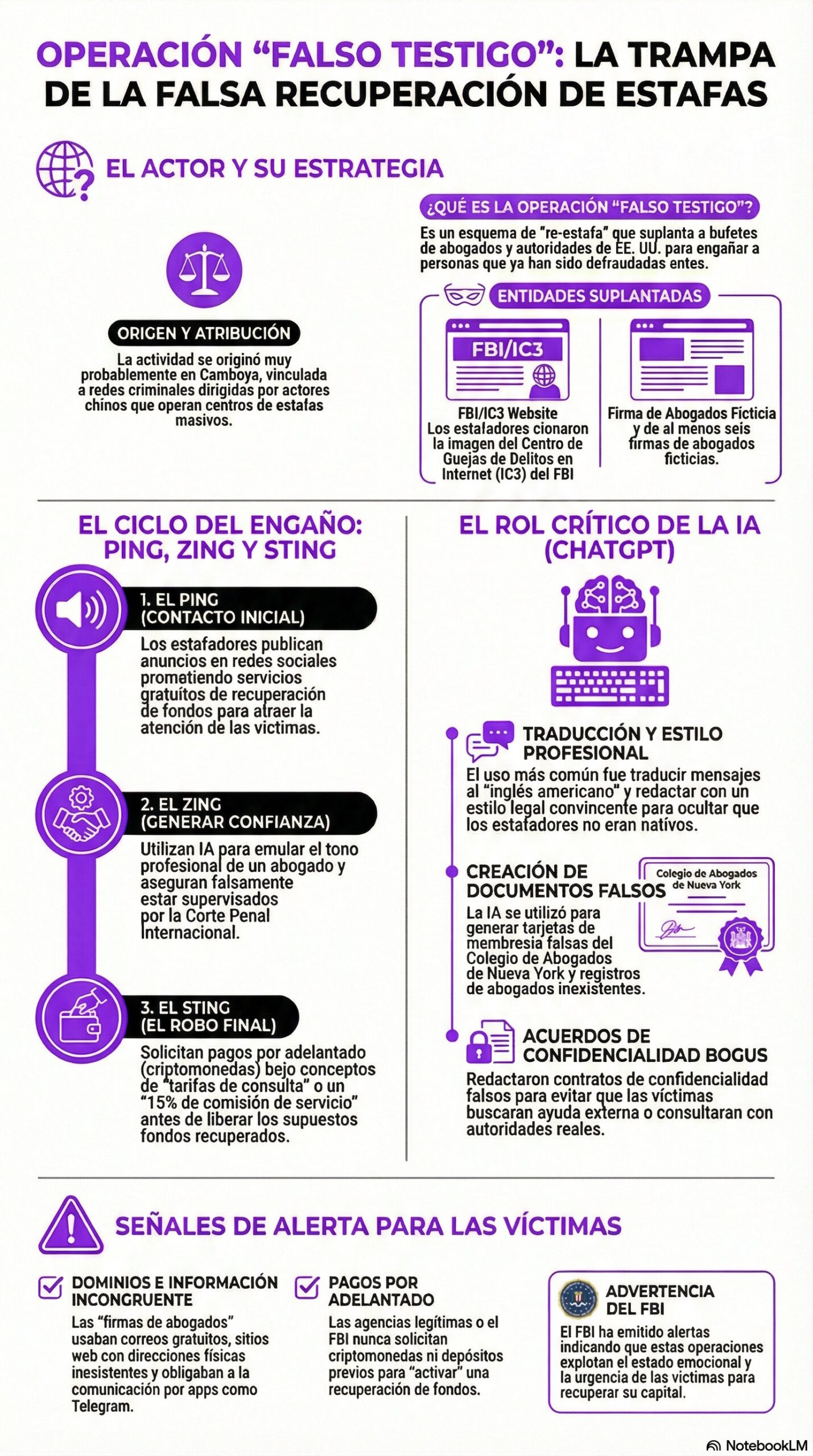

Operación “False Witness”: Falsas firmas de abogados para víctimas de fraudes previos

El segundo esquema criminal bloqueado por OpenAI se enfocaba en personas que ya habían perdido dinero en fraudes anteriores. Los atacantes utilizaban los modelos de texto para redactar comunicaciones que imitaban el tono profesional de bufetes de abogados estadounidenses.

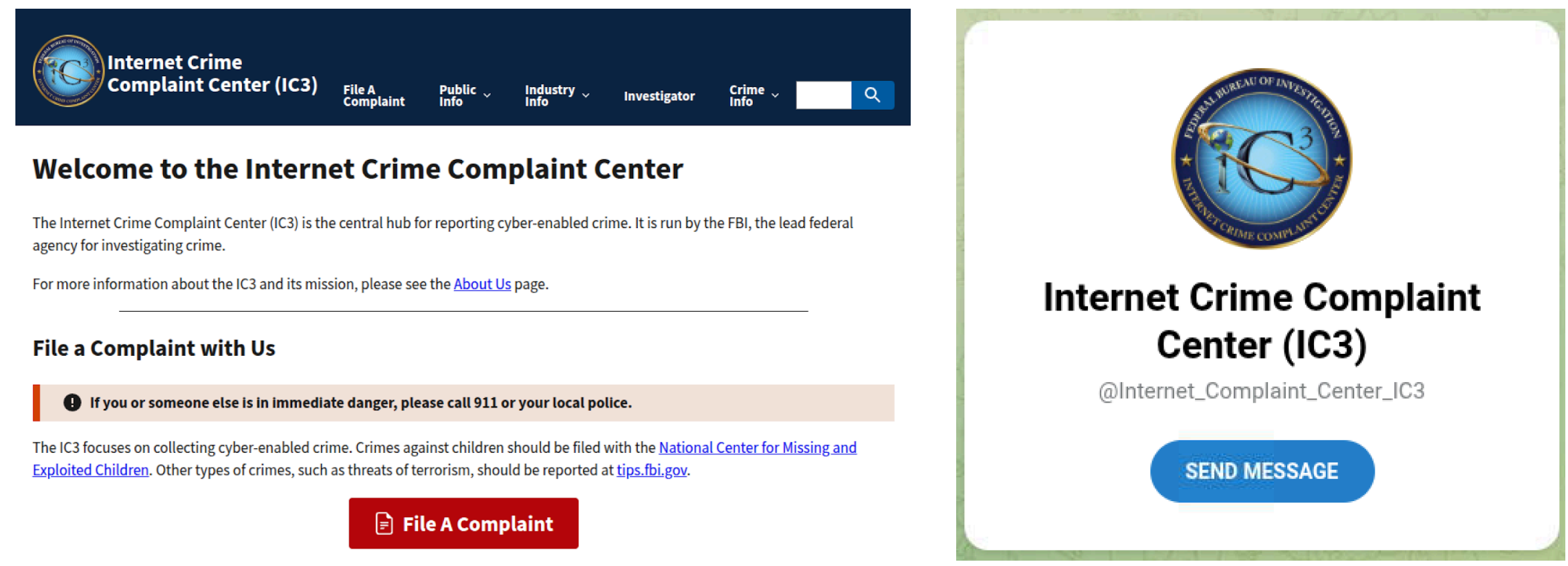

La firma destaca que suplantaron la identidad de la unidad de crímenes en internet del FBI para ofrecer falsos servicios de recuperación de fondos:

Para que el engaño pareciera real, operaban así:

- Alternativamente, solicitaban depósitos en criptomonedas antes de ofrecer cualquier supuesta ayuda.

- Pedían a la IA traducciones cuidadosas y textos escritos en inglés estadounidense.

- Contactaban a la víctima por aplicaciones de mensajería privada.

- Luego exigían un pago por adelantado, como una “tarifa de servicio” del 15%.

El equipo de seguridad de la empresa señaló que enfrentar a estos grupos es complejo, porque ajustan sus tácticas con rapidez y cambian de canal cuando son detectados. Por eso, explicaron que no basta con bloquear cuentas; también se debe estudiar en detalle cómo difunden el engaño y por qué logra llegar a tantas personas.

El nivel de complejidad de estos engaños automatizados deja una lección simple: conviene moverse con cautela en el entorno digital. Como regla básica, desconfíe de promesas de dinero fácil o de vínculos afectivos repentinos en internet, porque si algo suena demasiado bueno para ser cierto, con frecuencia es un fraude.