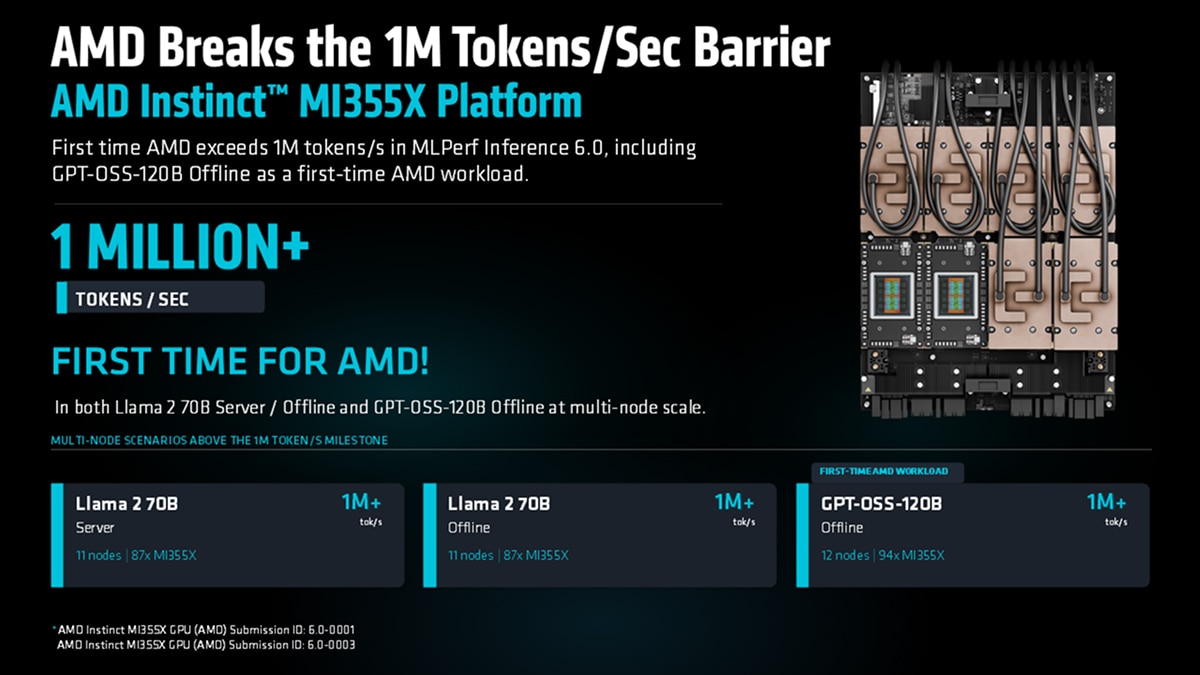

El avance de la IA exige una capacidad de cómputo masiva para procesar contenidos complejos de forma casi instantánea. Las recientes evaluaciones estandarizadas (MLPerf Inference 6.0) de la industria revelan cómo la GPU AMD Instinct MI355X logra satisfacer estas exigencias manteniendo una eficiencia constante.

Los resultados de estas pruebas técnicas detallan el comportamiento del hardware al ejecutar modelos de lenguaje masivos (LLM). Estos datos oficiales confirman un incremento comprobable en la velocidad de respuesta dentro de extensas redes de servidores interconectados a gran escala.

El hardware analizado logró cruzar la marca del millón de tokens procesados por segundo operando en servidores multinodo. Este hito técnico comprobable demuestra una gran capacidad de respuesta frente a las demandas computacionales más intensivas de la actualidad.

Arquitectura técnica y adaptabilidad ante algoritmos masivos de la GPU AMD Instinct MI355X

Estos componentes integran tecnología de fabricación de 3nm con cientos de miles de millones de transistores en su diseño. Dicha estructura física permite alojar enormes modelos algorítmicos aprovechando eficientemente su amplia memoria interna de alta velocidad.

La GPU analizada incluye 185 mil millones de transistores y opera con 288GB de memoria HBM3E. Este diseño estructural alcanza diez petaflops de capacidad de procesamiento y soporta modelos de hasta 520 mil millones de parámetros.

Resultados en tareas multimodales emergentes

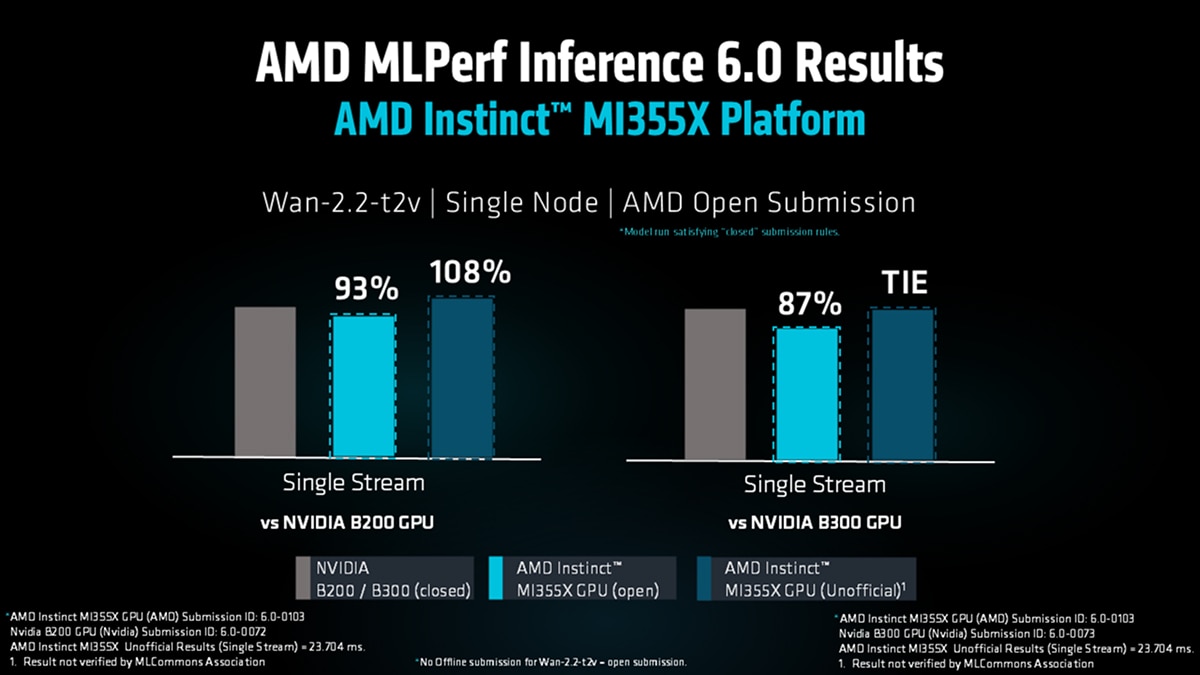

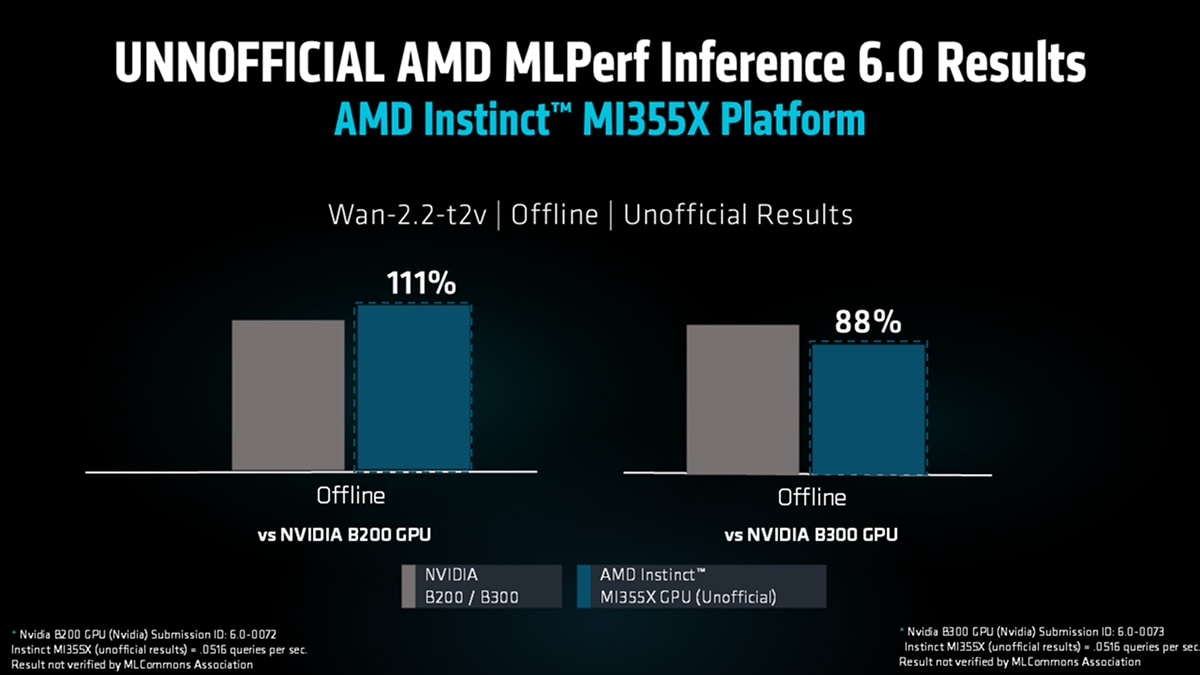

Las evaluaciones documentadas por AMD abarcaron por primera vez la generación de secuencias de video desde indicaciones textuales directas. Este soporte operativo temprano confirma la fiabilidad del ecosistema para procesar exigencias multimodales complejas y de reciente creación.

Estas métricas se registraron al ejecutar el modelo Wan-2.2-t2v bajo condiciones de transmisión única de datos. El sistema comprobó su capacidad de adaptación técnica frente a nuevos requerimientos al mantener un nivel de respuesta sumamente estable.

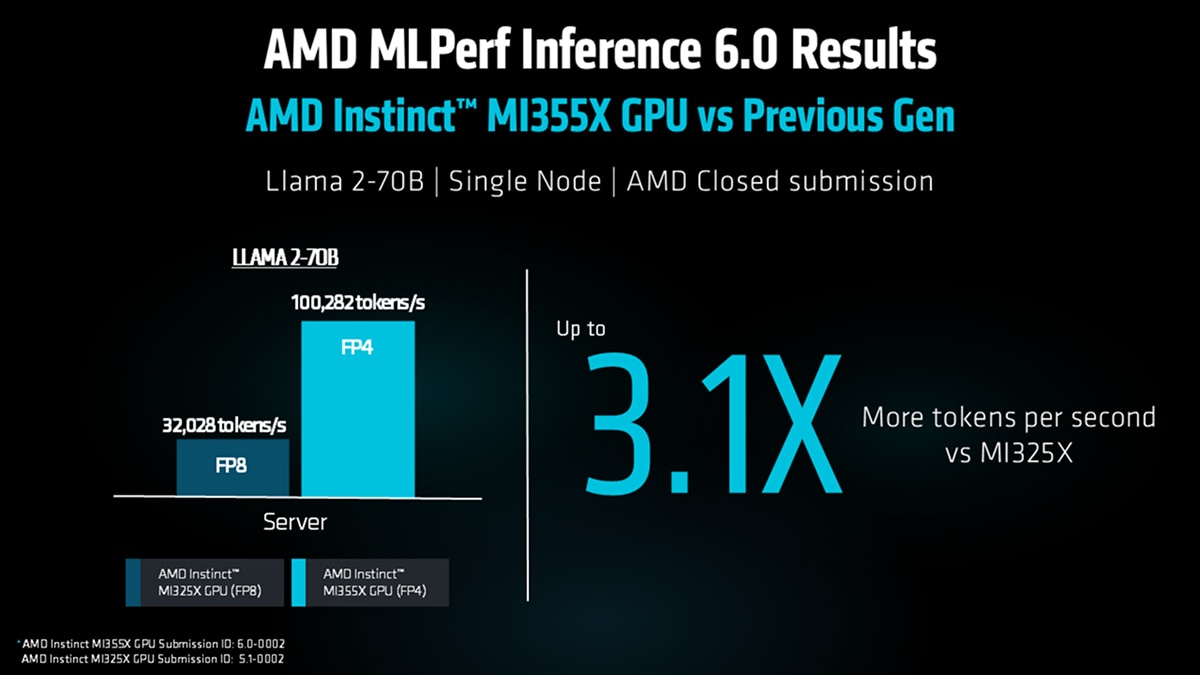

Evolución matemática y procesamiento de lenguajes

El volumen de cálculos métricos registró un crecimiento notable al compararse directamente con la versión de procesadores anterior. Esta evolución matemática constata la eficacia del diseño central al momento de ejecutar tareas intensivas dentro de los centros de datos.

En cifras precisas, el hardware logró procesar 100.282 tokens por segundo utilizando la red estructurada Llama 2 de 70 mil millones de parámetros. Este resultado equivale a un rendimiento 3,1 veces mayor al obtenido por la familia de componentes inmediatamente anterior.

.

Consistencia operativa en redes de servidores distribuidos

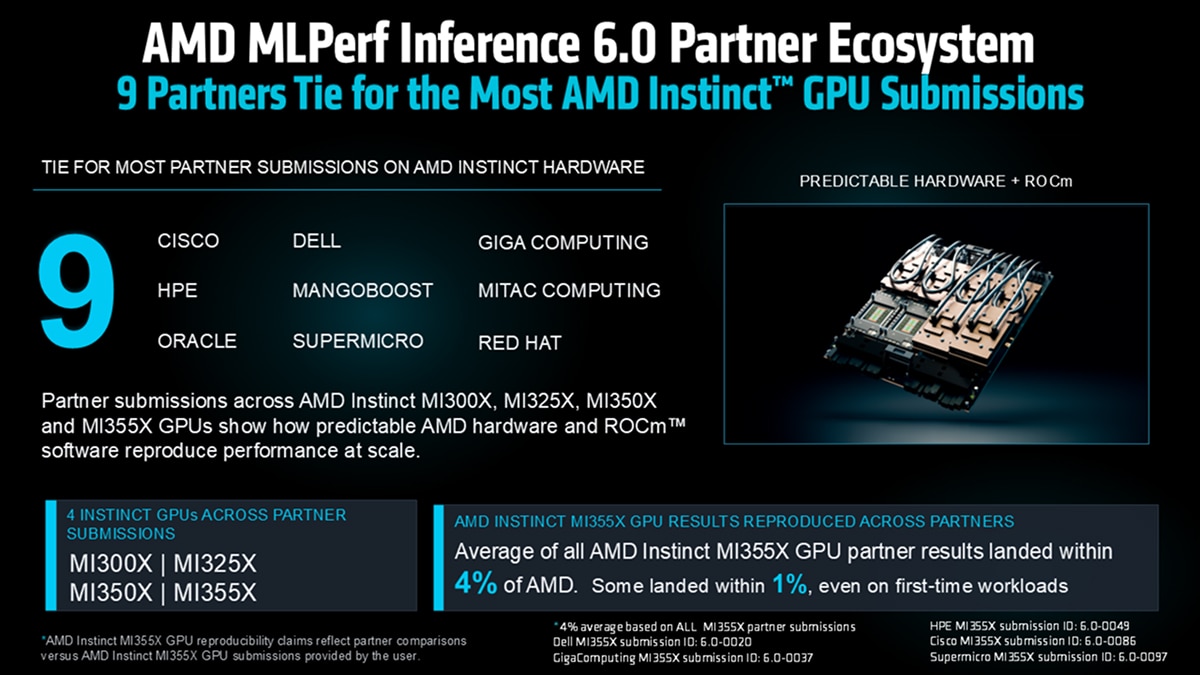

Distintos fabricantes de infraestructura lograron replicar exactamente estos valores de rendimiento dentro de sus propios equipos de laboratorio. Dicha coherencia técnica demuestra la estabilidad de las piezas al ser ensambladas bajo configuraciones de hardware sumamente diversas.

Un total de nueve socios tecnológicos documentaron sus propias métricas utilizando múltiples versiones de estas tarjetas gráficas. Los resultados obtenidos por estos actores independientes mostraron un margen de diferencia mínimo frente a las cifras originales.

Flexibilidad logística en infraestructuras heterogéneas

Un programa informático centralizado se encarga de coordinar la comunicación simultánea entre múltiples tarjetas instaladas en la red. Esta distribución inteligente de datos resulta indispensable al momento de gestionar cargas operativas enormes dirigidas hacia diversos nodos.

Los análisis finalmente validaron el funcionamiento sincronizado de servidores ubicados en distintos continentes operando como una sola unidad. Esta flexibilidad logística permite aprovechar plenamente la infraestructura existente sin forzar un reemplazo temprano de los equipos electrónicos instalados.