En el marco de GTC 2026, NVIDIA presentó Vera CPU como un procesador diseñado para cargas de IA centradas en razonamiento, aprendizaje por refuerzo e inferencia agentic. La compañía lo sitúa como una nueva base de CPU para fábricas de IA, con foco en rendimiento por núcleo, ancho de banda de memoria y eficiencia energética a gran escala.

NVIDIA sitúa a Vera CPU dentro de un flujo de trabajo donde el modelo de IA acelerado por GPU se coordina con grandes volúmenes de evaluación sobre CPU. Ese intercambio entre generación, validación y retorno de resultados es una de las bases técnicas que la compañía usa para justificar el papel de Vera en cargas de aprendizaje por refuerzo e inferencia agentic.

Arquitectura Olympus y subsistema de memoria de NVIDIA Vera CPU

La propuesta se apoya en 88 núcleos Olympus diseñados por NVIDIA. Cada uno puede ejecutar dos tareas mediante NVIDIA Spatial Multithreading, con la idea de sostener un rendimiento predecible en entornos multiusuario y cargas simultáneas.

La siguiente figura detalla la arquitectura presentada por NVIDIA; muestra la distribución de los núcleos Olympus, el subsistema de memoria LPDDR5X, la interconexión NVLink-C2C y la lógica de entrada y salida que articula el chip dentro de la plataforma.

Vera CPU dispone de un subsistema de memoria LPDDR5X con hasta 1.2 TB/s de ancho de banda. Según NVIDIA, esta configuración entrega 2x más ancho de banda y reduce a la mitad el consumo frente a CPU de propósito general.

La compañía también afirma que Vera CPU entrega resultados 2x más eficientes y 50% más rápidos que CPU tradicionales de rack. Ese perfil apunta a cargas como compiladores, motores de ejecución, analítica, herramientas agentic y servicios de orquestación.

Escalabilidad de Vera CPU e interconexión dentro de la plataforma Vera Rubin

NVIDIA no presenta Vera CPU como un componente aislado, sino como parte de una infraestructura pensada para escalar miles de instancias concurrentes dentro de una fábrica de IA. En esa lógica, la CPU se integra con racks de alta densidad, enlaces coherentes con GPU y una capa de red y seguridad acelerada.

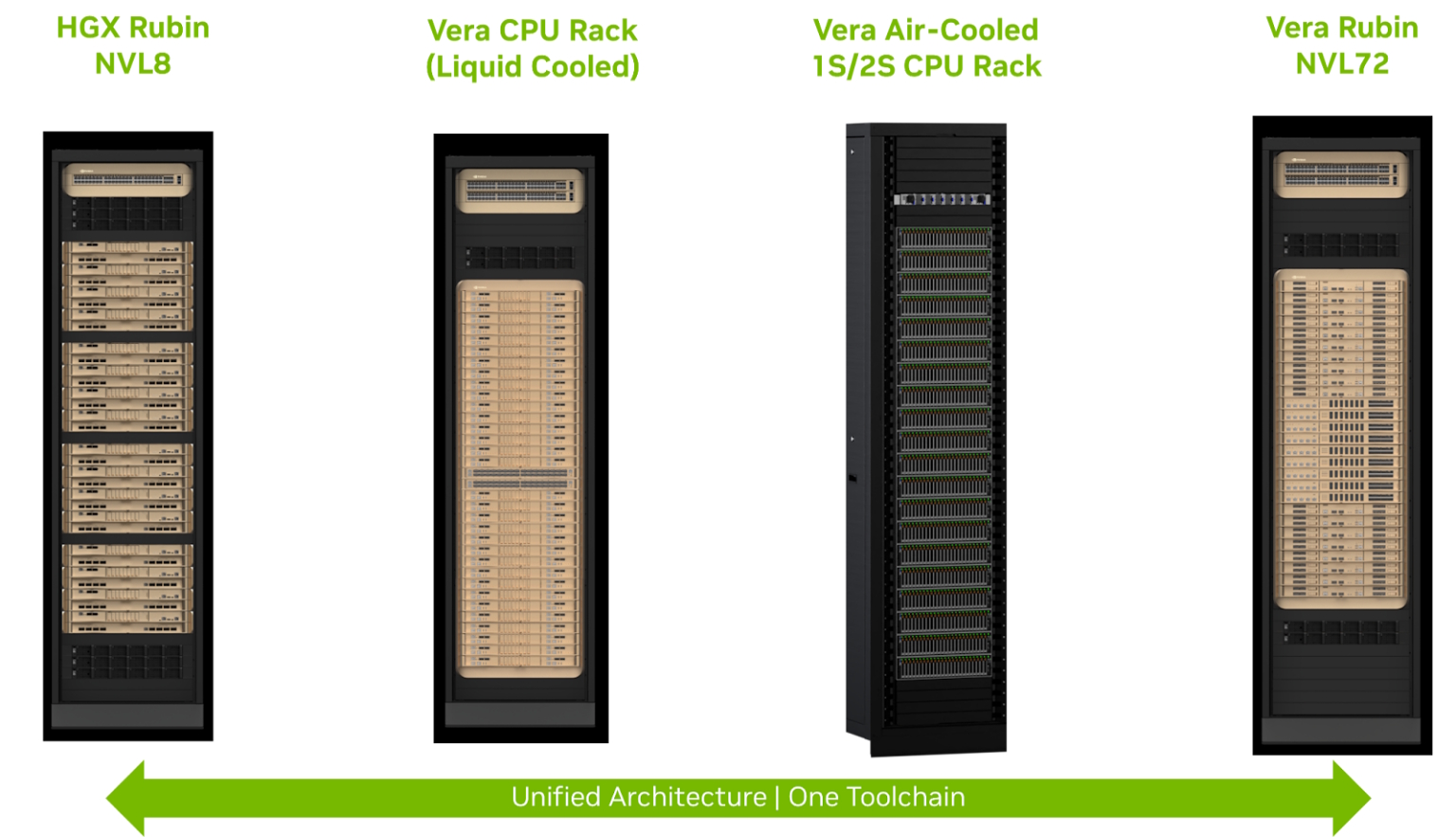

Vera CPU aparece integrada en una arquitectura más amplia que abarca desde sistemas HGX Rubin NVL8 hasta racks dedicados de CPU y configuraciones Vera Rubin NVL72, con la idea de mantener una base común de despliegue a escala de fábrica de IA (Ver imagen).

Dentro de esta arquitectura, NVIDIA anunció un rack con 256 Vera CPU y refrigeración líquida, capaz de sostener más de 22.500 entornos de CPU concurrentes por bastidor. El diseño se apoya en la arquitectura modular NVIDIA MGX, que permite adaptar la configuración a distintas cargas de trabajo.

Como parte de la plataforma Vera Rubin, Vera CPU se conecta con GPU mediante NVLink-C2C, con 1.8 TB/s de ancho de banda coherente. NVIDIA sostiene que esa cifra equivale a 7x el ancho de banda de PCIe Gen 6, con el objetivo de evitar cuellos de botella en el intercambio de datos.

La plataforma también incorpora ConnectX SuperNIC y BlueField-4 DPU para acelerar red, almacenamiento y seguridad. Además, los socios del ecosistema podrán ofrecer configuraciones de servidor de uno y dos sockets, según las exigencias de aprendizaje por refuerzo, inferencia agentic, procesamiento de datos, orquestación y computación de alto desempeño.