NVIDIA presentó BlueField-4 STX como una arquitectura de referencia modular para desplegar almacenamiento acelerado en entornos de IA y forma parte de la arquitectura Vera Rubin.. El anuncio se enfoca en una limitación concreta de los centros de datos tradicionales, donde el acceso a contexto extenso puede frenar la inferencia y reducir la utilización de GPU,

La propuesta busca crear una capa de almacenamiento más cercana al área de cómputo. Con ello, la compañía apunta a sostener cargas de entrenamiento, inferencia y analítica con una ruta de datos más estable para modelos que trabajan con memoria contextual y sesiones de larga duración.

NVIDIA BlueField-4 STX y la plataforma CMX de memoria contextual

En su primera implementación a escala de rack, STX incorpora la nueva plataforma NVIDIA CMX. Esta capa amplía la memoria útil del sistema con un enfoque orientado a inferencia escalable y a flujos agentic que requieren acceso continuo a grandes volúmenes de contexto.

Según NVIDIA, la arquitectura se apoya en una combinación de procesamiento, red y software diseñada específicamente para almacenamiento de IA. El objetivo es que los proveedores puedan desplegar una base modular que mantenga los datos accesibles sin alejarse del entorno de cálculo.

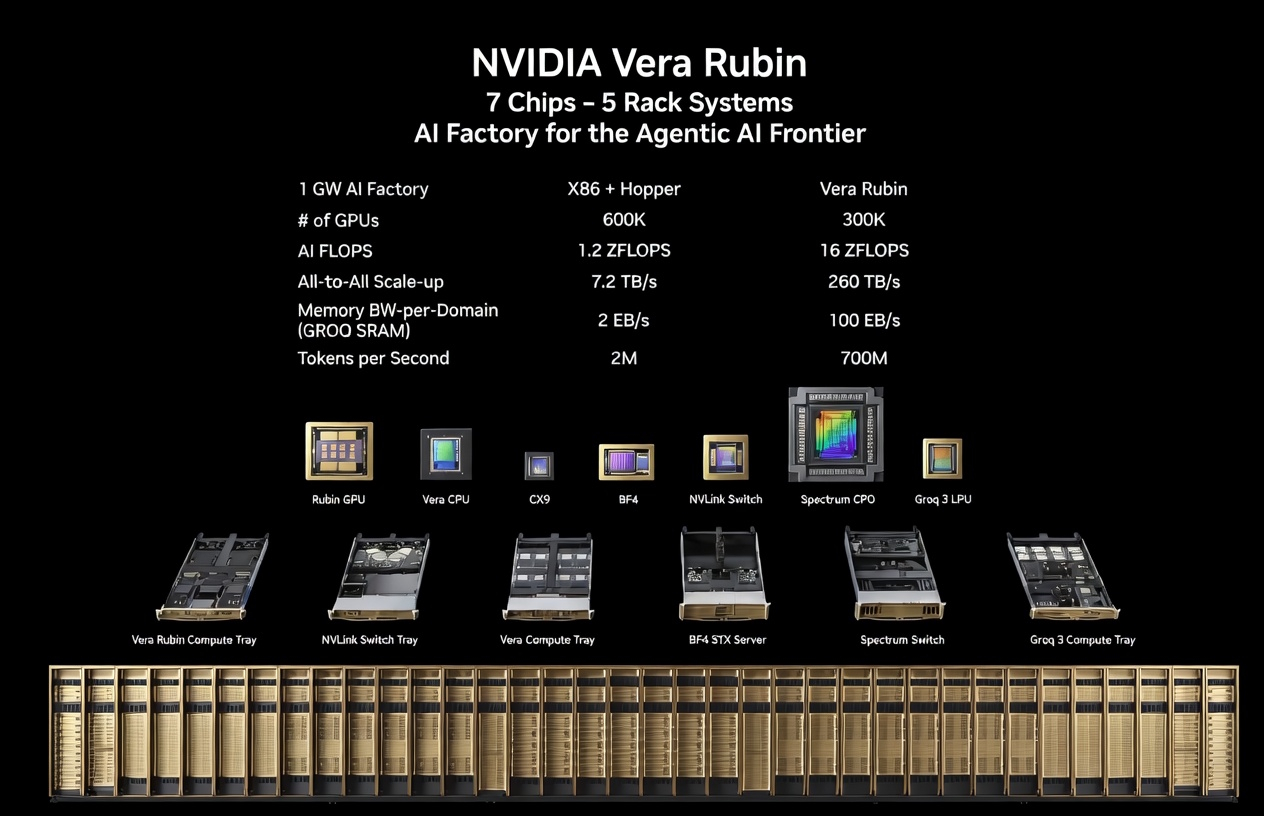

La NVIDIA BlueField-4 STX es una arquitectura de referencia modular para almacenamiento acelerado en AI factories, anunciada en el marco de la GTC 2026, optimizada para razonamiento de amplio contexto en agentic AI.

Rendimiento, socios y disponibilidad de NVIDIA BlueField-4 STX

NVIDIA atribuye a STX una mejora de hasta 5x en tokens por segundo frente al almacenamiento tradicional. A eso suma una eficiencia energética de hasta 4x frente a arquitecturas de CPU para almacenamiento de alto desempeño, junto con una capacidad de ingesta de datos de hasta 2x más páginas por segundo para cargas empresariales de IA.

El anuncio también subraya que la arquitectura ya está siendo tomada como base por distintas capas del ecosistema.

Entre los socios de almacenamiento aparecen Cloudian, DDN, Dell Technologies, Everpure, Hitachi Vantara, HPE, IBM, MinIO, NetApp, Nutanix, VAST Data y WEKA, mientras que en manufactura se mencionan AIC, Supermicro y Quanta Cloud Technology.

En adopción prevista para memoria contextual, NVIDIA identifica a CoreWeave, Crusoe, IREN, Lambda, Mistral AI, Nebius, Oracle Cloud Infrastructure y Vultr. La disponibilidad general de plataformas basadas en STX fue proyectada para la segunda mitad de 2026.