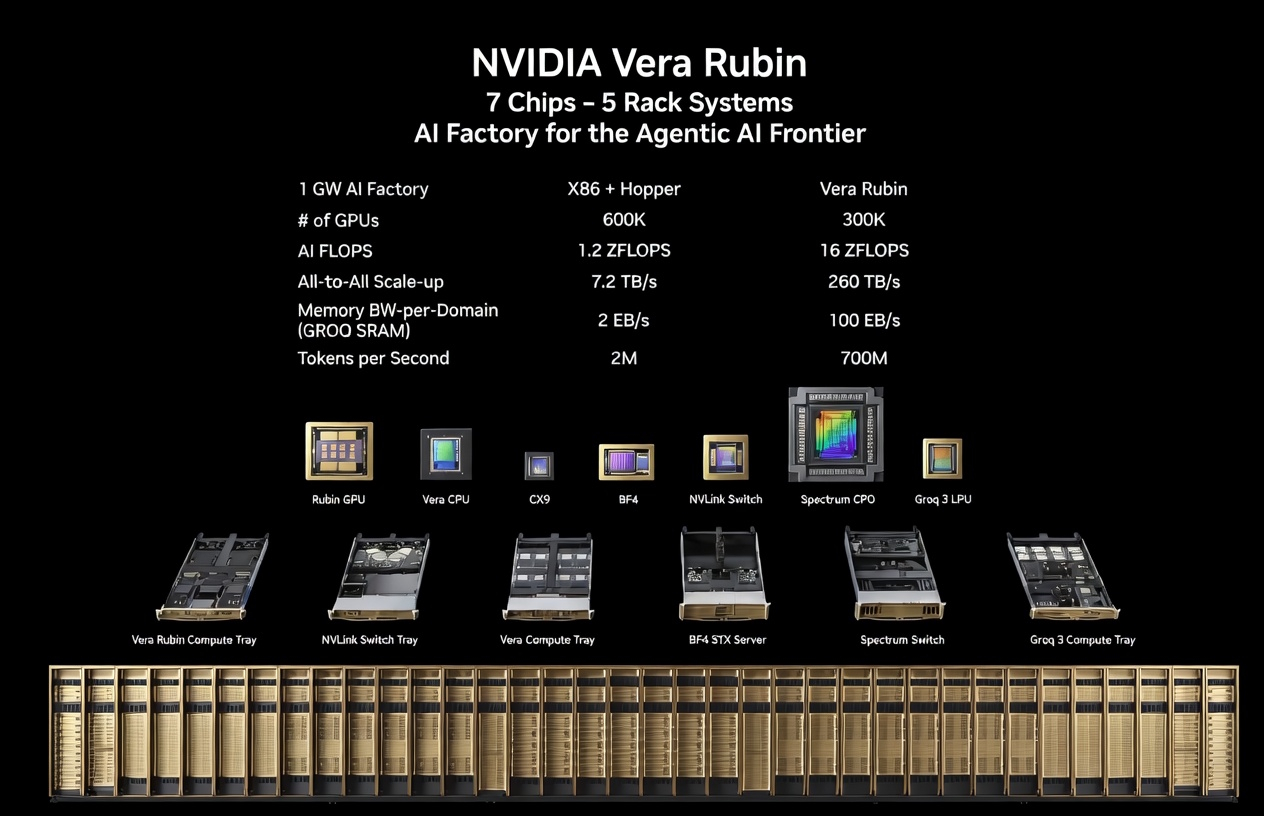

NVIDIA presentó a Vera Rubin como una plataforma pensada para cubrir distintas etapas del trabajo con IA. El anuncio combina cómputo, red, almacenamiento y gestión energética en una arquitectura que apunta desde el pretraining hasta la inferencia agentic.

La base del anuncio no está en un solo chip, sino en un sistema completo de racks especializados. Esa lógica permite distribuir funciones dentro de la fábrica de IA y ajustar la infraestructura según el tipo de carga que se quiera ejecutar.

Vera Rubin NVL72 y Vera CPU Rack como base de la plataforma

El núcleo de Vera Rubin parte con el rack NVL72, orientado a entrenamiento e inferencia a gran escala. A su lado aparece el Vera CPU Rack, que entrega capacidad adicional para validación, sincronización y ejecución de entornos basados en CPU.

En conjunto, ambos bloques forman la base computacional de la plataforma. NVIDIA los presenta como una combinación de GPU y CPU integrada a nivel de rack, con énfasis en densidad, eficiencia y coordinación entre componentes.

- GPU y CPU del rack NVL72: 72 GPU Rubin y 36 CPU Vera conectadas por NVLink 6.

- Interconexión adicional: integración con ConnectX-9 SuperNICs y BlueField-4 DPUs.

- Eficiencia de entrenamiento: modelos mixture-of-experts con 1/4 de las GPU frente a NVIDIA Blackwell.

- Inferencia por vatio: hasta 10x más throughput por watt.

- Costo por token: hasta 1/10 del costo por token indicado por NVIDIA.

- Escalabilidad de red: compatibilidad con Quantum-X800 InfiniBand y Spectrum-X Ethernet.

- Rack de CPU: 256 CPU Vera sobre infraestructura NVIDIA MGX con refrigeración líquida.

- Desempeño frente a CPU tradicionales: 2x más eficiencia y 50% más velocidad.

NVIDIA Groq 3 LPX Rack para inferencia de baja latencia

Dentro de la plataforma, NVIDIA incorpora el rack Groq 3 LPX como una pieza especializada en inferencia determinista y de baja latencia. Su función es responder a cargas que requieren contextos amplios y una ejecución más predecible en modelos de gran tamaño.

La compañía lo posiciona como un complemento del entorno Vera Rubin. La idea es que LPX y NVL72 trabajen de forma conjunta en tareas de inferencia donde importan tanto la velocidad como la eficiencia energética.

La NVIDIA Groq 3 LPX es un acelerador de inferencia de IA a escala de rack diseñado para la plataforma Vera Rubin, con 256 aceleradores LPU Groq 3 interconectados para workloads agénticos de baja latencia. Cada LPU ofrece 500 MB de SRAM, 150 TB/s de ancho de banda SRAM y 2.5 TB/s de ancho de banda scale-up, optimizado para generación de tokens junto a GPUs Rubin.