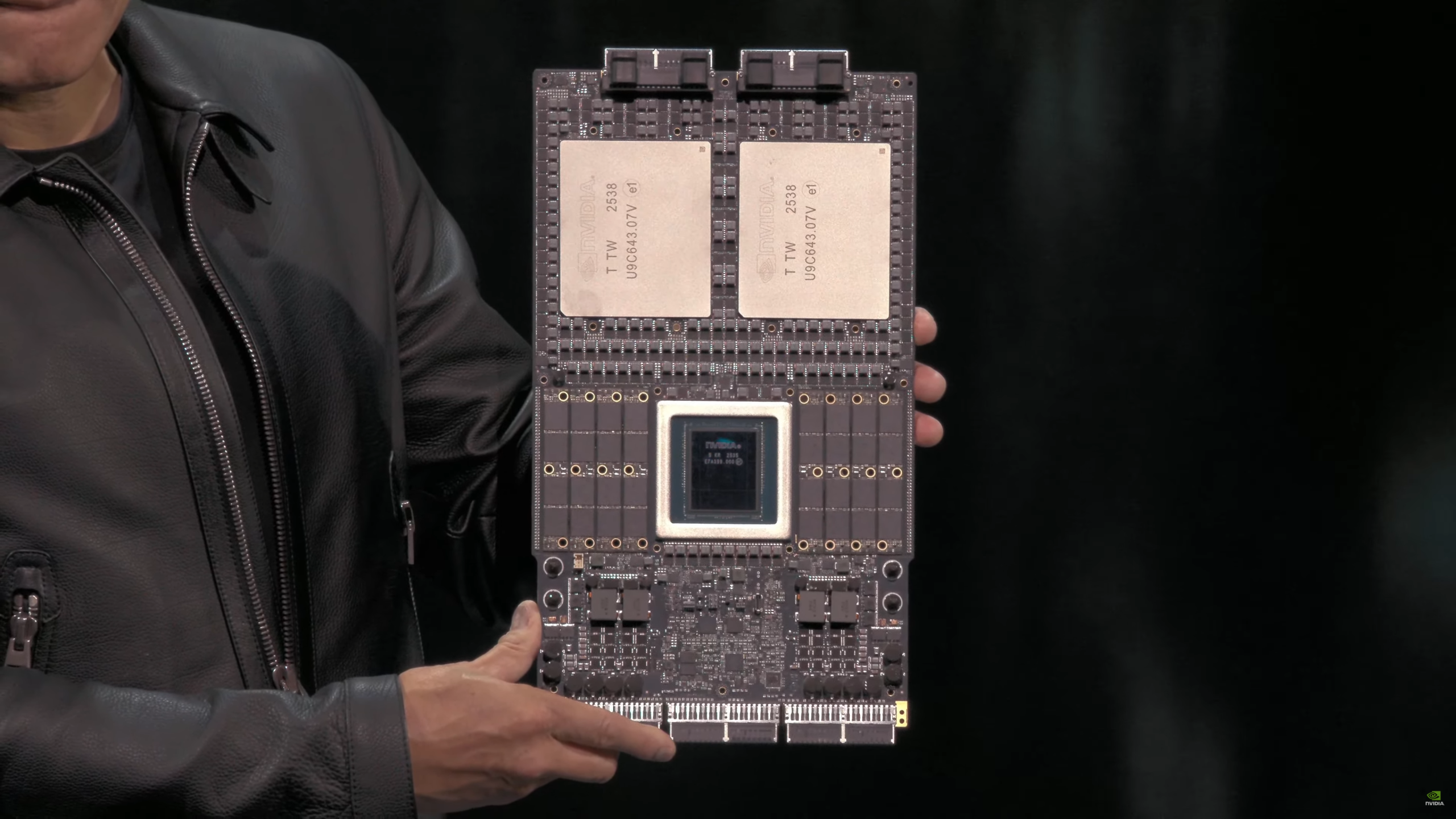

Uno de los gigantes de la fabricación de memorias, Micron, ha anunciado oficialmente el inicio de la producción en volumen de varias tecnologías clave de memoria y almacenamiento destinadas a la plataforma NVIDIA Vera Rubin. Este ambicioso despliegue incluye la innovadora memoria HBM4, las veloces unidades SSD PCIe Gen6 y los módulos SOCAMM2.

Este movimiento estratégico refuerza enormemente el ecosistema alrededor de los centros de datos de inteligencia artificial, entornos donde la velocidad del almacenamiento juega un papel crítico para el rendimiento global de cualquier servidor o computador de alto rendimiento.

La compañía ha confirmado que estas soluciones están diseñadas específicamente para integrarse con la arquitectura Vera Rubin, consolidando una colaboración estrecha con NVIDIA para escalar la potencia en cargas de IA generativa, tanto en la etapa de entrenamiento como en la de inferencia.

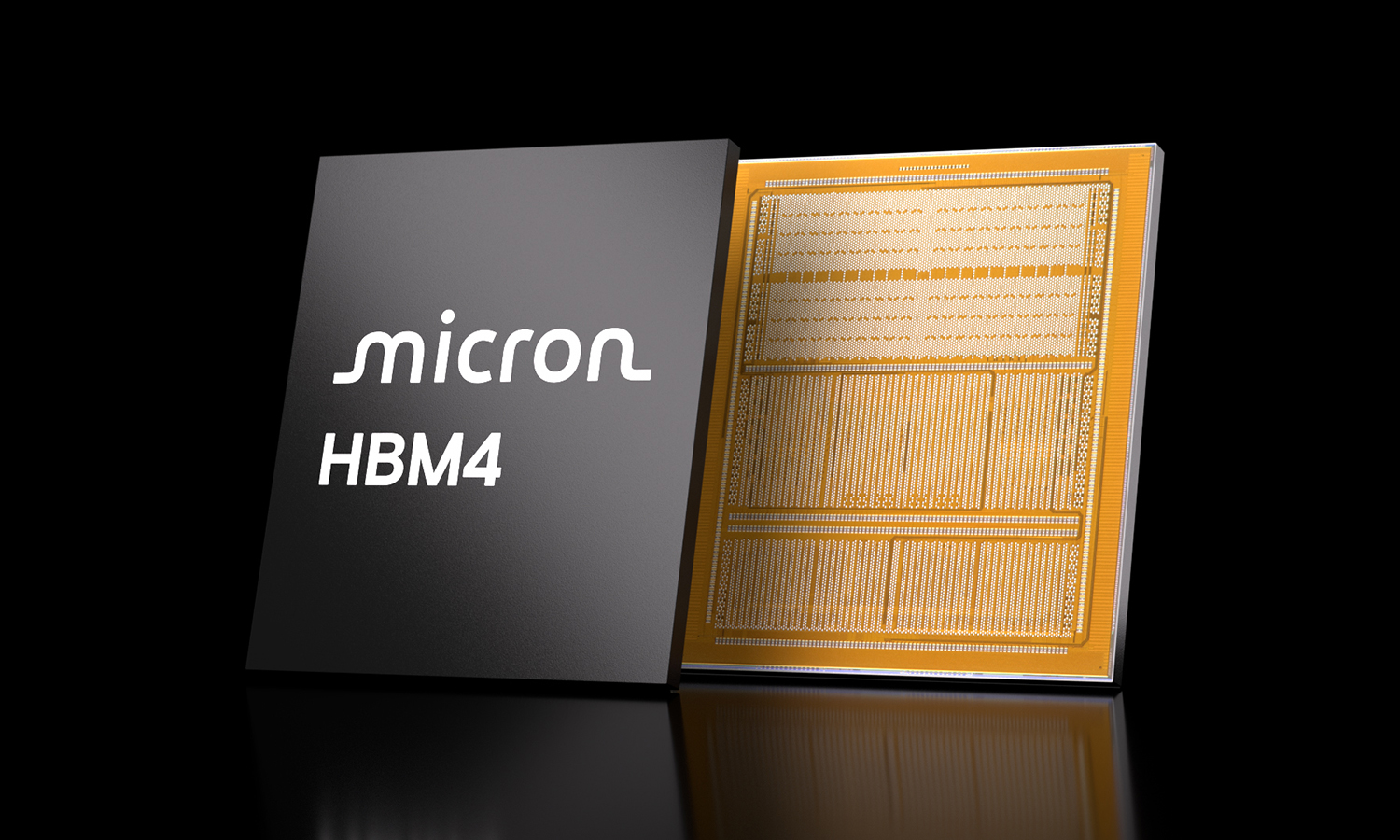

HBM4 de Micron: Mayor ancho de banda y máxima eficiencia energética

Uno de los elementos más relevantes de este anuncio es la memoria HBM4, que ya ha entrado en fase de producción masiva en su configuración de 36 GB (12H). Esta memoria alcanza velocidades superiores a 11 Gb/s por pin y ofrece un impresionante ancho de banda superior a 2.8 TB/s, lo que supone una mejora de rendimiento de aproximadamente 2.3 veces respecto a la tecnología HBM3E.

Además del enorme salto en velocidad, Micron destaca una mejora superior al 20% en su eficiencia energética, un factor indispensable en los centros de datos donde el consumo eléctrico es uno de los principales retos operativos. La compañía también ha adelantado importantes avances en encapsulado, mostrando prototipos de módulos HBM4 de 48 GB (16H) con un apilado de 16 matrices, lo que representa un incremento de capacidad de un 33% por pila.

Unidades SSD PCIe Gen6 y SOCAMM2 para expandir el ecosistema

En el apartado del almacenamiento puro, Micron se convierte en el primer fabricante mundial en iniciar la producción en volumen de un SSD PCIe Gen6 exclusivo para centros de datos: el modelo Micron 9650. Esta unidad está minuciosamente optimizada para cargas de IA agentiva y para funcionar junto a la arquitectura BlueField-4 STX de NVIDIA.

El almacenamiento ofrece hasta 28 GB/s de lectura secuencial y hasta 5.5 millones de IOPS en lectura aleatoria, duplicando el rendimiento respecto a las actuales soluciones PCIe Gen5. Por otro lado, los módulos SOCAMM2 también entran en producción con capacidades de hasta 192 GB, formando parte de una gama que abarca desde los 48 GB hasta los 256 GB. Estas memorias están diseñadas para sistemas Vera Rubin NVL72, permitiendo alcanzar hasta 2 TB de memoria por CPU con un ancho de banda masivo de hasta 1.2 TB/s.

La memoria como pilar de la infraestructura de inteligencia artificial con Micron y NVIDIA

El despliegue conjunto de la memoria HBM4, los módulos SOCAMM2 y los veloces SSD PCIe Gen6 refuerza la importancia vital del almacenamiento dentro del diseño de infraestructuras de próxima generación. A medida que los modelos de lenguaje crecen en tamaño y complejidad, la capacidad de mover datos de forma eficiente se convierte en un factor totalmente determinante.

La estrategia de Micron pasa por ofrecer soluciones integradas que escalen junto al silicio de GPU y las arquitecturas de servidores, alineándose con el enfoque de plataformas completas que impulsa NVIDIA. Esta colaboración refleja una tendencia clara en el sector: el desarrollo conjunto donde memoria, procesador y almacenamiento evolucionan de forma coordinada.

¿Por qué la memoria HBM4 es crucial para el futuro de la inteligencia artificial generativa?

La memoria HBM4 representa el pilar tecnológico fundamental para la evolución de la inteligencia artificial porque logra eliminar el severo cuello de botella que existe tradicionalmente entre el procesador gráfico (GPU) y el almacenamiento de datos. En el entrenamiento de modelos masivos, las tarjetas gráficas requieren acceder a miles de millones de parámetros en fracciones de segundo.

La arquitectura de altísimo ancho de banda de la HBM4 permite alimentar de información a la GPU a la velocidad exacta que esta necesita para operar al máximo de su capacidad instalada, evitando tiempos de inactividad. Además, su notable optimización térmica y energética permite a las granjas de servidores escalar sus operaciones globales sin sobrepasar los límites críticos de consumo eléctrico de las instalaciones.

¿Qué te parece el anuncio de Micron junto a NVIDIA?