La conversación con Johanna Abrigo se enmarca en el aniversario 20 de AWS y en la revisión del papel que cumplen sus partners cuando la nube deja de ser solo infraestructura para migrar cargas. Morris & Opazo participa en ese ecosistema como partner de AWS en Chile y Latinoamérica, con trabajo en data, modernización, IA generativa y proyectos que buscan llevar modelos desde pruebas controladas hacia entornos productivos.

La entrevista se concentra en ese paso técnico: cómo cambia una arquitectura cloud cuando entra IA generativa, por qué la gobernanza de datos se vuelve crítica, qué exige integrar modelos en procesos sensibles y qué separa una demo de un sistema que debe operar todos los días con datos reales, monitoreo y trazabilidad.

¿Cómo cambia una arquitectura cloud cuando el foco pasa a IA generativa?

La adopción de IA generativa cambió el tipo de conversación técnica que Morris & Opazo sostiene alrededor de los proyectos. Abrigo sitúa esa transición en una etapa AI-first, donde la nube deja de ser el punto final y pasa a ser la base para rediseñar procesos, productos y operación.

“El cambio ha sido profundo. Antes nuestro foco estaba en data, migración y modernización; hoy estamos en una etapa claramente AI-first”.

Ese desplazamiento obliga a mirar la tecnología desde su impacto operativo. Para una audiencia técnica, el punto relevante no está solo en adoptar modelos generativos, sino en definir casos de uso, preparar datos, construir MVPs y escalar soluciones cuando funcionan sobre datos reales.

“La llegada de la IA generativa no solo transformó la tecnología, sino también la conversación con los clientes. Pasamos de implementar soluciones a diseñar capacidades de innovación dentro de las organizaciones. Ya no se trata solo de desplegar tecnología, sino de ayudar a los clientes a redefinir sus procesos, productos e incluso su modelo de negocio”.

La velocidad también cambia la forma de ejecutar. Abrigo describe ciclos más cortos, donde el trabajo se acerca a la operación y busca validar resultados en semanas, no en meses, sin separar estrategia, datos y tecnología.

“Esto también cambió nuestra forma de trabajar. Hoy estamos mucho más cerca del negocio: acompañamos a los clientes en la identificación y priorización de casos de uso, construimos MVPs en tiempos muy acotados y luego los escalamos a producción. Combinamos estrategia, datos y tecnología en ciclos mucho más rápidos, donde el valor se empieza a capturar en semanas, no en meses”.

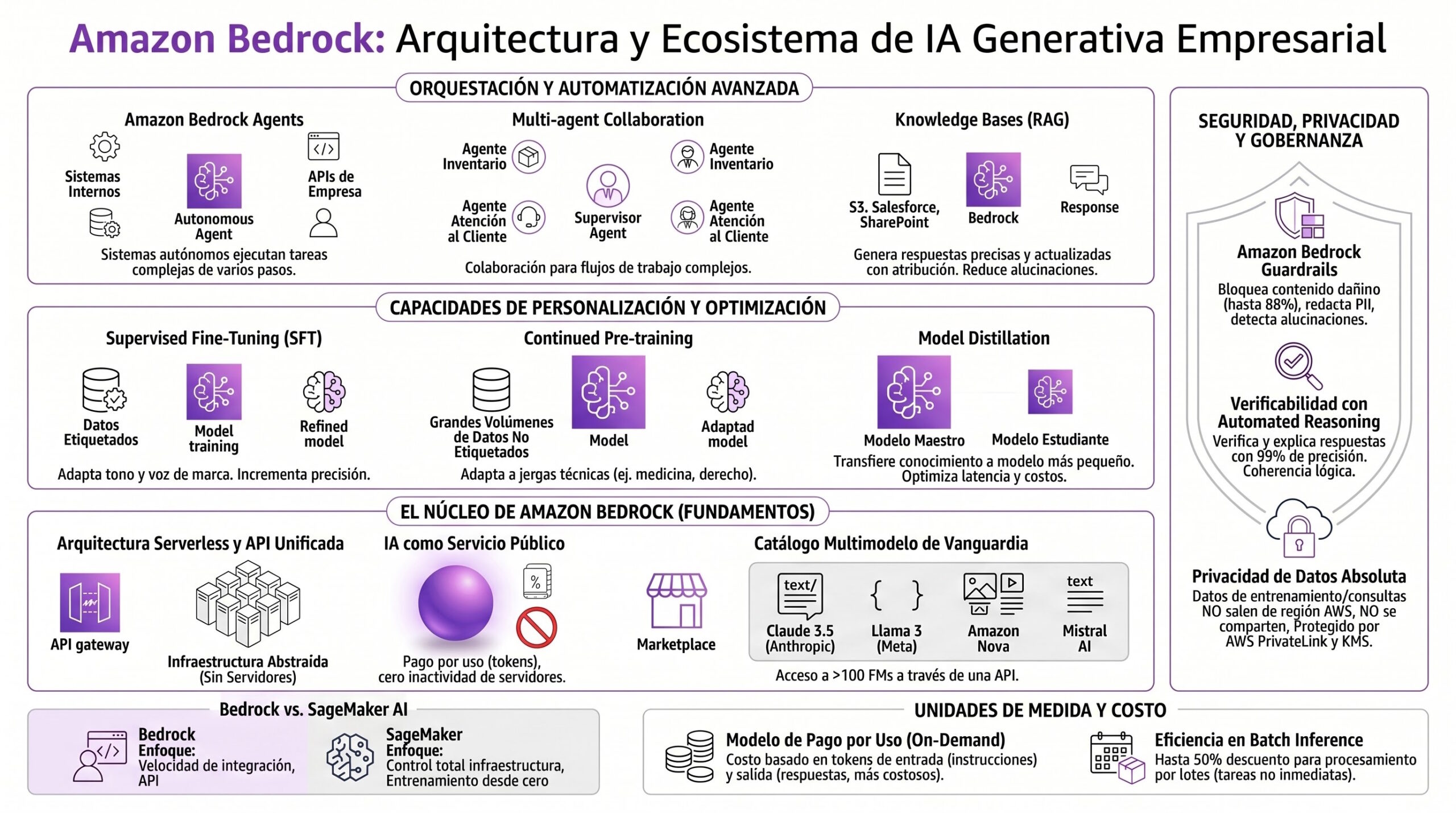

Dentro de ese marco, Amazon Bedrock aparece como una herramienta para acelerar desarrollos con IA generativa. Abrigo, sin embargo, pone el énfasis en el cambio cultural que se produce cuando las empresas dejan de buscar solo eficiencia y empiezan a reorganizar procesos alrededor de la IA.

“Herramientas como Amazon Bedrock nos permiten acelerar este proceso, pero el verdadero cambio es cultural: las empresas ya no buscan solo eficiencia, están buscando reinventarse a través de la inteligencia artificial, mejorando procesos, disminuyendo tiempos, y mejorando inclusive la rentabilidad en algunos casos”.

Nota: Amazon Bedrock es un servicio administrado de AWS para crear aplicaciones de IA generativa con modelos fundacionales de distintos proveedores, usando APIs, controles de seguridad y capacidades de personalización sin administrar infraestructura propia.

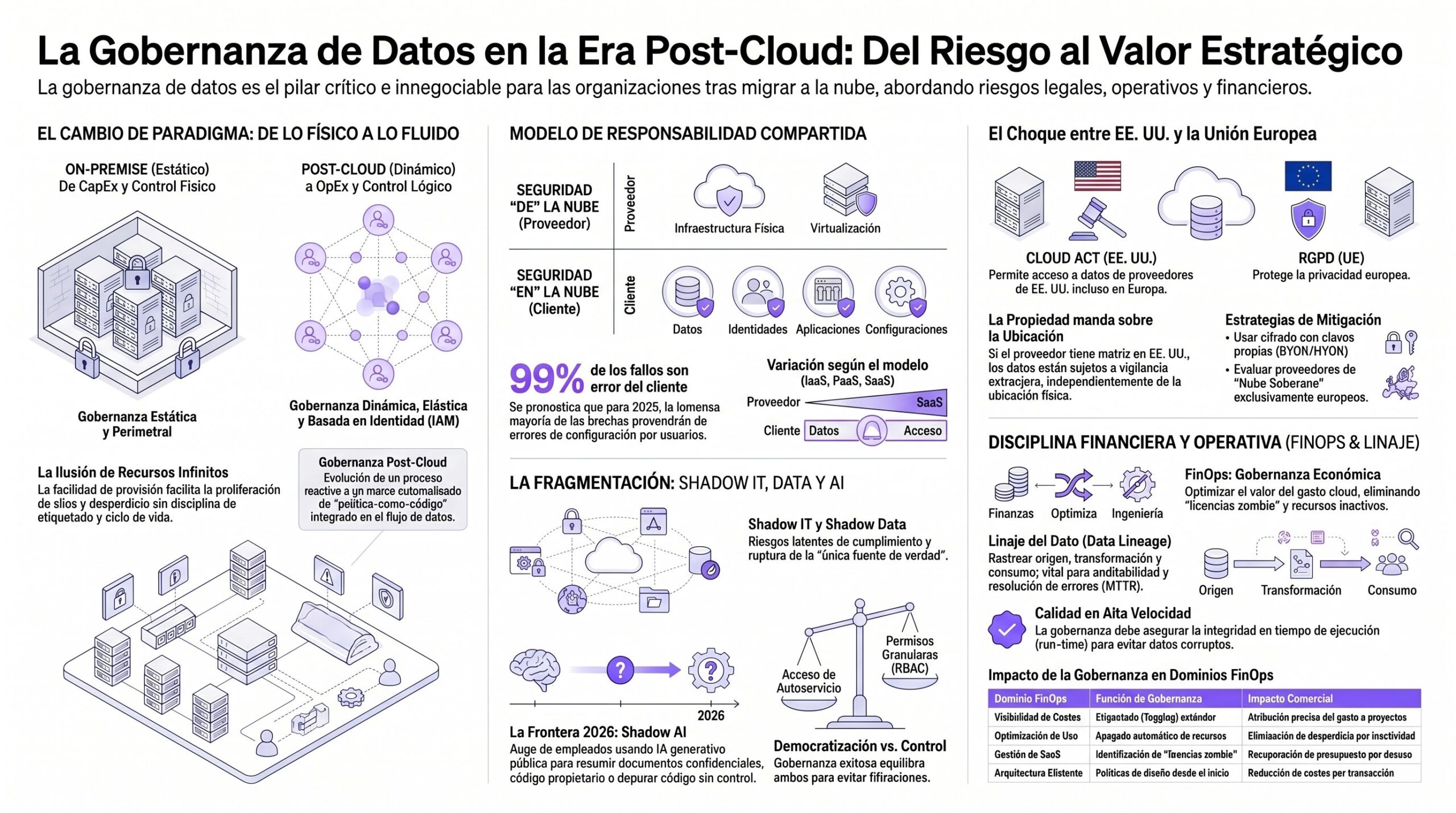

¿Por qué la gobernanza de datos se vuelve crítica después de migrar a cloud?

Ese cambio empezó a consolidarse entre 2022 y 2023, cuando las organizaciones ya no preguntaban únicamente cómo migrar, sino cómo extraer valor de los datos acumulados en entornos cloud. La IA aparece ahí como consecuencia técnica de una base de información que ya existe, pero que necesita orden, control y disponibilidad para operar bien.

Con la madurez cloud, la discusión dejó de girar solo en torno al traslado de cargas y empezó a concentrarse en la calidad, trazabilidad y uso de los datos. Esa transición abrió el espacio para aplicar IA sobre información centralizada, siempre que existan criterios claros de gobierno, acceso y consistencia.

“Durante años, la conversación era ‘migrar a la nube’. Pero una vez que los clientes comenzaron a madurar en cloud, la pregunta cambió rápidamente a: ¿Cómo genero valor con mis datos?”.

La nube funciona entonces como una base de escalamiento para datos e IA, pero no resuelve por sí sola el problema técnico. Sin arquitectura consistente, gobernanza y datos accesibles, cualquier implementación de inteligencia artificial queda limitada desde el diseño.

“Ahí la IA entró de forma natural. Hoy la nube ya no es el objetivo, es el habilitador para poder escalar iniciativas de datos e inteligencia artificial que impacten directamente en el negocio”.

La gobernanza de datos define qué información puede usarse, bajo qué controles y con qué nivel de trazabilidad. Sin esa capa, la IA puede escalar sobre datos incompletos, inconsistentes o mal clasificados, afectando precisión, seguridad y confiabilidad desde el origen.

¿Qué exige una IA generativa cuando entra a procesos críticos?

Según Abrigo, hoy las conversaciones se ordenan alrededor de casos de uso de IA generativa aplicados por industria, integración en procesos críticos y resultados verificables en plazos más cortos.

“Hoy vemos un cambio muy claro en las necesidades:”.

En ese nuevo escenario, la GenAI no se evalúa solo por su capacidad de producir respuestas, sino por su integración con flujos operativos concretos. Fraude, atención al cliente y operaciones aparecen como ámbitos donde la tecnología debe convivir con sistemas existentes, datos reales y exigencias de control.

“Casos de uso concretos de IA generativa aplicados al negocio, segmentados por industria. […] Integración de IA en procesos críticos como fraude, atención al cliente y operaciones”.

La expectativa de velocidad obliga a construir, probar y escalar con mayor disciplina. La arquitectura ya no basta si no entrega resultados medibles en menos tiempo y con controles desde el inicio.

“Resultados en semanas, no en meses. […] Y algo clave: gobernanza, seguridad y control desde el día uno”.

El cambio en la conversación se resume en una diferencia clara: antes el énfasis estaba en arquitectura; ahora, en cómo esa arquitectura se traduce en eficiencia, operación y experiencia para usuarios internos y externos.

“Antes hablábamos de arquitectura. Hoy hablamos de impacto directo en revenue, eficiencia y experiencia de cliente, tanto interna como externa”.

¿Qué cambia cuando una IA pasa de demo a producción?

Bolsa de Productos de Chile y Approbe permiten marcar una frontera concreta entre una prueba controlada y una implementación productiva. El modelo es solo una parte del sistema, porque la exigencia aparece cuando la IA debe procesar datos reales, integrarse con sistemas existentes, responder con baja latencia y sostener estabilidad operacional.

“Lo que nos dejaron tanto el trabajo con la Bolsa de Productos de Chile como con Approbe es una lección muy clara: la diferencia entre una demo y producción no está en el modelo, está en el impacto real en la operación”.

En Bolsa de Productos, el desafío era auditar más de 2.000 facturas diarias en tiempo real, una carga que vuelve impracticable una revisión manual permanente. La implementación requería análisis documental a escala, detección de anomalías y procesamiento consistente sobre millones de documentos.

“En el caso de la Bolsa de Productos, el desafío era auditar más de 2.000 facturas diarias en tiempo real, algo que simplemente no era viable de forma manual. La IA generativa no se implementó como un experimento, sino como una solución crítica para el negocio, capaz de analizar millones de documentos, detectar anomalías y aumentar la seguridad y transparencia del mercado”.

Approbe lleva el problema al terreno de las transacciones masivas y la detección de fraude, donde el margen de error afecta directamente el riesgo financiero. La mejora citada por Abrigo, desde tasas cercanas al 70% hasta alrededor de 95% de detección, pone el foco en precisión, datos reales y continuidad operacional.

“Por otro lado, con Approbe, el foco estaba en un problema igual de tangible: mejorar la detección de fraude en un volumen masivo de transacciones. Pasamos de tasas cercanas al 70% a alrededor de un 95% de detección, impactando directamente el riesgo financiero del negocio”.

Llevar una IA a producción obliga a validar el sistema completo, no solo la calidad de una respuesta generada en pruebas. La integración, los datos a escala, el monitoreo, la estabilidad y la evolución del modelo pasan a ser condiciones de funcionamiento cuando la solución queda expuesta a uso real.

“Ambos casos nos demostraron que llevar IA a producción implica tres cosas clave: primero, integrarse profundamente en los procesos del negocio; segundo, trabajar con datos reales y en escala; y tercero, asegurar que el modelo esté en operación continua, con monitoreo y evolución constante”.

Cuando la IA trabaja sobre procesos críticos, la diferencia ya no está en demostrar una capacidad, sino en sostenerla todos los días. El sistema debe responder en tiempo real, mantener trazabilidad y comportarse como una pieza operacional integrada, no como una prueba aislada.

“En definitiva, la IA deja de ser una innovación cuando empieza a operar todos los días, en tiempo real, resolviendo problemas críticos. Ahí es donde realmente se convierte en una capacidad de negocio, y no en una demo”.

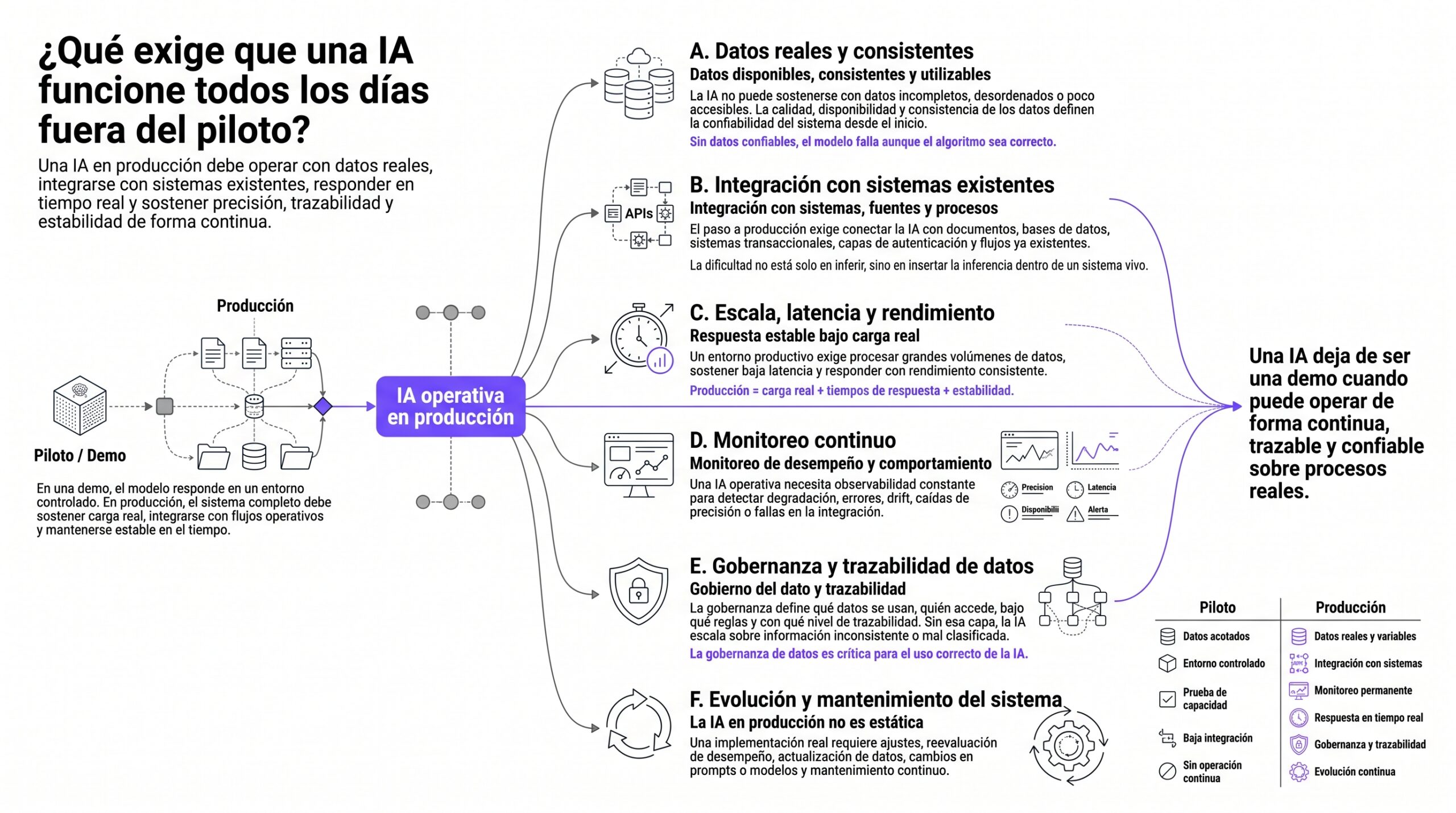

¿Qué exige que una IA funcione todos los días fuera del piloto?

La dificultad principal no estuvo en construir modelos aislados, sino en hacer que funcionaran todos los días dentro de sistemas reales. Para un proyecto de IA en producción, el entorno operacional pesa tanto como el algoritmo.

“Lo más difícil no fue construir los modelos, sino lograr que funcionaran de manera consistente en la operación diaria”.

Esa consistencia depende de factores que suelen estar fuera del modelo: calidad y disponibilidad de datos, integración con sistemas existentes y capacidad de operar en tiempo real y a gran escala. Sin esas condiciones, el piloto puede funcionar, pero la producción se vuelve frágil.

“En ambos casos, tanto en la Bolsa de Productos como en Approbe, el mayor desafío estuvo en todo lo que rodea a la IA: la calidad y disponibilidad de los datos, la integración con sistemas existentes y, sobre todo, llevar estas soluciones a un entorno donde deben operar en tiempo real y a gran escala”.

Abrigo aterriza ese desafío en cargas concretas: miles de facturas por día y análisis de transacciones para fraude. En esos escenarios, latencia, precisión, robustez de arquitectura y monitoreo dejan de ser atributos deseables y pasan a ser condiciones de funcionamiento.

“Por ejemplo, procesar miles de facturas al día o analizar transacciones para detectar fraude no admite errores ni tiempos de respuesta lentos. Eso exige arquitecturas robustas, modelos bien ajustados y, además, un monitoreo constante para asegurar que el desempeño se mantenga en el tiempo”.

El factor humano también incide en la operación. Integrar IA en procesos críticos requiere confianza en los resultados, adaptación de flujos de trabajo y comprensión de que el sistema debe evolucionar después del despliegue inicial.

“A esto se suma un factor clave: el cambio cultural. Integrar IA en procesos críticos implica que los equipos confíen en los resultados, adapten sus flujos de trabajo y entiendan que esto no es una solución estática, sino una capacidad que evoluciona”.

La diferencia entre prueba y producción queda sintetizada en la idea de un sistema vivo. El modelo debe integrarse al negocio y responder de forma sostenida con precisión, velocidad y confiabilidad.

“En definitiva, lo más desafiante es pasar de un modelo que funciona en pruebas a un sistema vivo, integrado al negocio, que debe responder todos los días con precisión, velocidad y confiabilidad”.

¿Qué falta para operar más IA en producción en Chile?

Pasar de un piloto a producción en Chile exige resolver capas concretas: calidad y gobierno de datos, integración con sistemas existentes, monitoreo y criterios verificables para decidir si la IA puede escalar. En esa lectura, el problema no está solo en acceder a modelos, sino en sostenerlos con datos trazables y operación estable.

“[…] El siguiente paso es tomar decisiones más ambiciosas y llevarla a producción. Chile tiene el talento, la infraestructura y el acceso a tecnología de clase mundial. Sin embargo, para que veamos más casos de IA en producción y no solo pilotos, todavía faltan algunos elementos clave”.

La madurez de datos aparece como el primer filtro técnico para que una implementación no dependa de limpieza posterior, excepciones manuales o supuestos débiles sobre la información disponible. En la práctica, esa madurez incluye orden, gobierno, estructura y disponibilidad antes de conectar la IA a procesos reales.

“Primero, mayor madurez en las estrategias de datos […] La IA es tan buena como los datos que la alimentan, y muchas organizaciones aún están en proceso de ordenar, gobernar y estructurar su información”.

El paso de prueba a despliegue también necesita métricas verificables, porque una IA sostenida en producción debe mostrar eficiencia, reducción de errores o menor riesgo operacional. Sin esa lectura técnica, el piloto puede quedar correcto en laboratorio, pero sin prioridad para integrarse de forma permanente.

“Segundo, claridad en el retorno de inversión […] Esto permite que las empresas necesiten conectar la IA directamente con resultados de negocio, ya sea en eficiencia, ingresos o mitigación de riesgos para tomar decisiones más rápidas y con mayor convicción”.

El escalamiento aparece cuando la IA deja de funcionar como validación aislada y entra a sistemas que deben operar de forma continua. Esa transición supone integración, monitoreo y responsabilidad sobre el comportamiento del sistema una vez que queda expuesto a uso real.

“Y tercero, una decisión más audaz de escalar […] El gran salto está en llevar esas iniciativas a producción, integrarlas en procesos críticos y operarlas de forma continua”.

Abrigo cierra detallando que Chile puede tener condiciones favorables, pero la diferencia aparece cuando los proyectos dejan la exploración y se convierten en despliegues capaces de sostenerse a mayor escala.

“El desafío ya no es tecnológico, sino estratégico […] Chile está en una posición muy favorable, pero el siguiente paso es pasar de la exploración a la ejecución a gran escala”.