Google presentó en el MWC su asistente conversacional en vivo Gemini LIve, cuyo foco es incorporar video en vivo, para que el modelo puedea analizar a la persona y al enteron en tiempo real.

Gemini Live esta función permitirá a los usuarios mostrarle a la inteligencia artificial objetos, documentos o sitios web directamente desde sus teléfonos, este es el ejemplo compartido por Google. En pocas palabras es una versión de circle to search con esteroides.

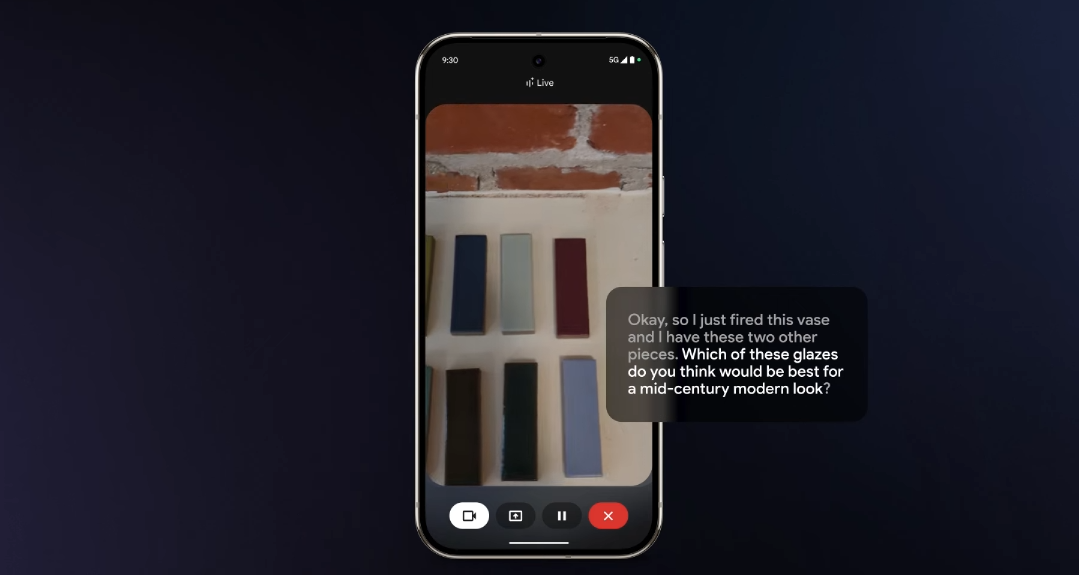

En el video, una persona le pregunta a Gemini Live qué esmaltes usar en sus piezas. El Asistente responde basándose en la imagen en pantalla, mostrando una capacidad avanzada de comprensión visual con el entorno.

La conversación se da en esta dinámica:

«Ok, acabo de cocer este jarrón y tengo estas otras dos piezas. ¿Cuál de estos esmaltes crees que sería mejor para un estilo moderno de mediados de siglo?»

Persona

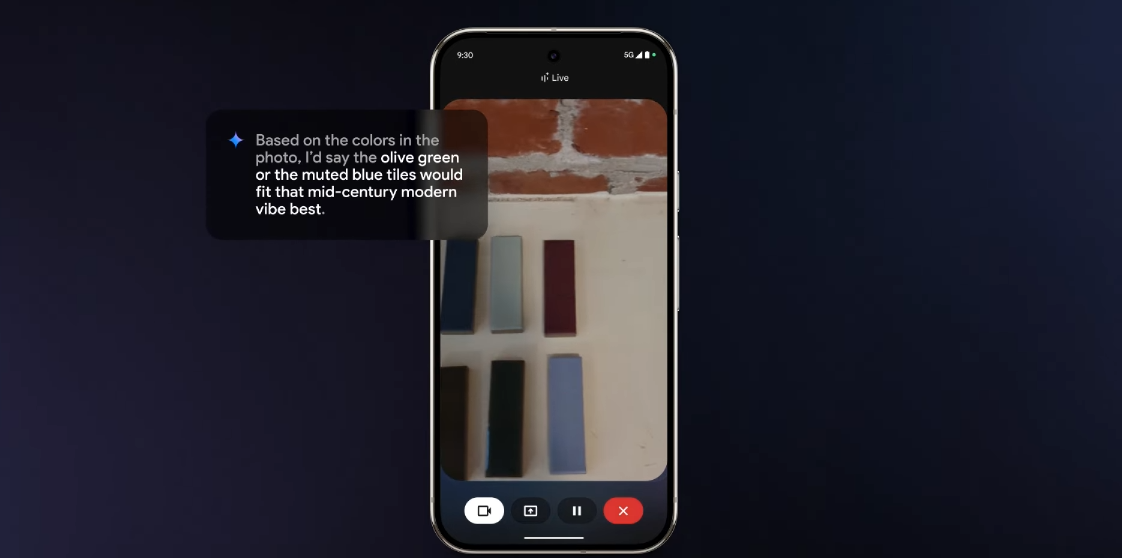

«Basado en los colores de la foto, diría que los azulejos verde oliva o azul apagado encajarían mejor con esa vibra moderna de mediados de siglo».

Google Gemini

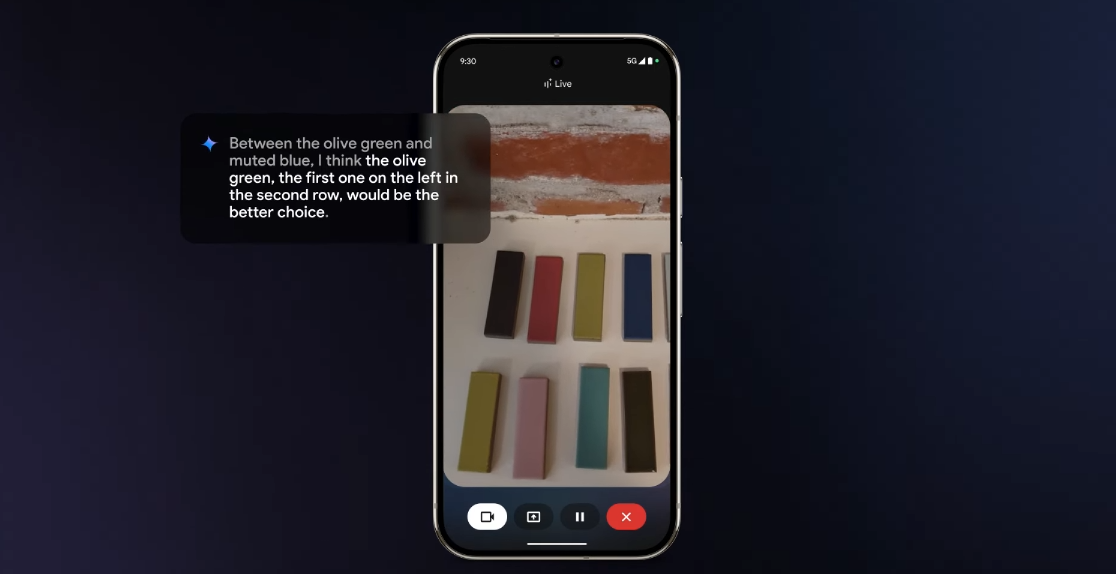

«Bueno, ¿cuál de esos combina mejor con las piezas que ya tengo esmaltadas?»

Persona

«Entre el verde oliva y el azul apagado, creo que el verde oliva, el primero a la izquierda en la segunda fila, sería la mejor elección.»

Google Gemini

La actualización estará disponible inicialmente para suscriptores de Gemini Advanced en Android a finales de marzo. Según Google, esta capacidad mejorará la interacción con la IA al proporcionar respuestas más contextuales y precisas, basándose en lo que el usuario le muestra en tiempo real.

La novedad de Live llega justo después de tener novedades respecto de Google Gemini 2.0 , que esa una versión mejorada del LLM de Google, con mayor capacidad de razonamiento y explicaciones más detalladas.

Aunque esta innovación podría cambiar la manera en que interactuamos con la IA, también plantea desafíos en privacidad y seguridad, especialmente en un contexto donde los Deep Fakes y la manipulación de video generan cada vez más preocupación.

¿Será este el futuro de los asistentes de IA o la gente será reticente a aceptar esta funcionalidad?