El equipo editorial conversó con Andrés Tahta, Managing Director de AWS Latin America, en una entrevista que cruzó pasado y presente. La pregunta de fondo ya no fue cómo convencer a las empresas de mirar la nube, sino qué cambia cuando la IA entra en una fase donde debe funcionar de verdad.

El vocero de AWS suma más de 25 años de experiencia en negocios internacionales, marketing y ventas en América Latina y Estados Unidos. Antes de su cargo actual, estuvo al frente de AWS para el sector público en Latinoamérica, con trabajo junto a organizaciones de gobierno, educación, salud y entidades sin fines de lucro.

Su trayectoria también incluye pasos por McKinsey & Company, Telecom Argentina, Telefónica y Movistar, además de la Agencia de Promoción de Inversiones y Comercio de Argentina. Es licenciado en Ciencias Políticas y Relaciones Internacionales por Dartmouth College y tiene un MBA por Harvard Business School.

De la nube cuestionada a una IA que ya no puede quedarse en piloto

Lo que aparece es una continuidad clara entre los primeros años de la nube y el momento actual de la IA. En ambos casos, la conversación comenzó entre dudas y terminó empujada por usos concretos.

“Hace dos décadas, muchos […] se preguntaban: ‘¿por qué la nube?’. […] se dieron cuenta de que la nube no era solo infraestructura, sino una plataforma para la innovación. […] existen paralelismos reales con los inicios de la nube. El verdadero valor de la nube no radicaba en reducir los costes de los centros de datos, sino en hacer posible la transformación […]”.

Ese recuerdo no aparece como una comparación casual; con esto en mente, sirve para explicar por qué hoy muchas empresas llegan atraídas por la IA, pero terminan enfrentándose a una realidad menos vistosa y mucho más exigente, donde importan la base de nube, la seguridad, los costos y la capacidad de operar a escala.

“[…] la IA no reemplazó a la nube como punto de entrada, sino que aceleró y profundizó la conversación […]. Hoy, muchos clientes entran directamente por inteligencia artificial […]. Sin embargo, lo que descubren rápidamente es que la IA a escala empresarial requiere una base de nube sólida. No se puede mover IA del piloto a la producción sin navegar la seguridad, la gestión del cambio y la optimización de costos a escala empresarial […]”.

Cuando los grandes modelos de lenguaje (LLM) dejaron de verse como experimentos de laboratorio y empezaron a entrar en cargas de trabajo reales, la discusión cambió de tono y también de velocidad.

“[…] Cuando los […] clientes vieron que los LLM pasaban de laboratorios de investigación a cargas de trabajo de producción, la conversación cambió instantáneamente de ¿deberíamos invertir en IA? a ¿qué tan rápido podemos construir?”.

El ejecutivo de AWS señala que una migración cloud tradicional puede concentrarse en infraestructura, eficiencia y modernización, pero un proyecto de IA obliga a entrar en capas más complejas, porque no basta con desplegar tecnología si los datos están mal gobernados o si la organización no logra absorber el cambio.

“Acompañar a un cliente en un proyecto de inteligencia artificial implica un nivel de complejidad y alcance significativamente mayor que una migración cloud tradicional. Mientras esta última se enfoca principalmente en infraestructura […] la IA exige abordar de manera integral aspectos como la calidad y gobierno de los datos, la seguridad, la gestión de modelos […]”.

La adopción regional empieza a dejar atrás la fase experimental

El vocero detalla que, según IDC, proyecta que hacia 2027 las 5.000 principales empresas de América Latina destinarán más del 25% de su presupuesto de TI a iniciativas de IA.

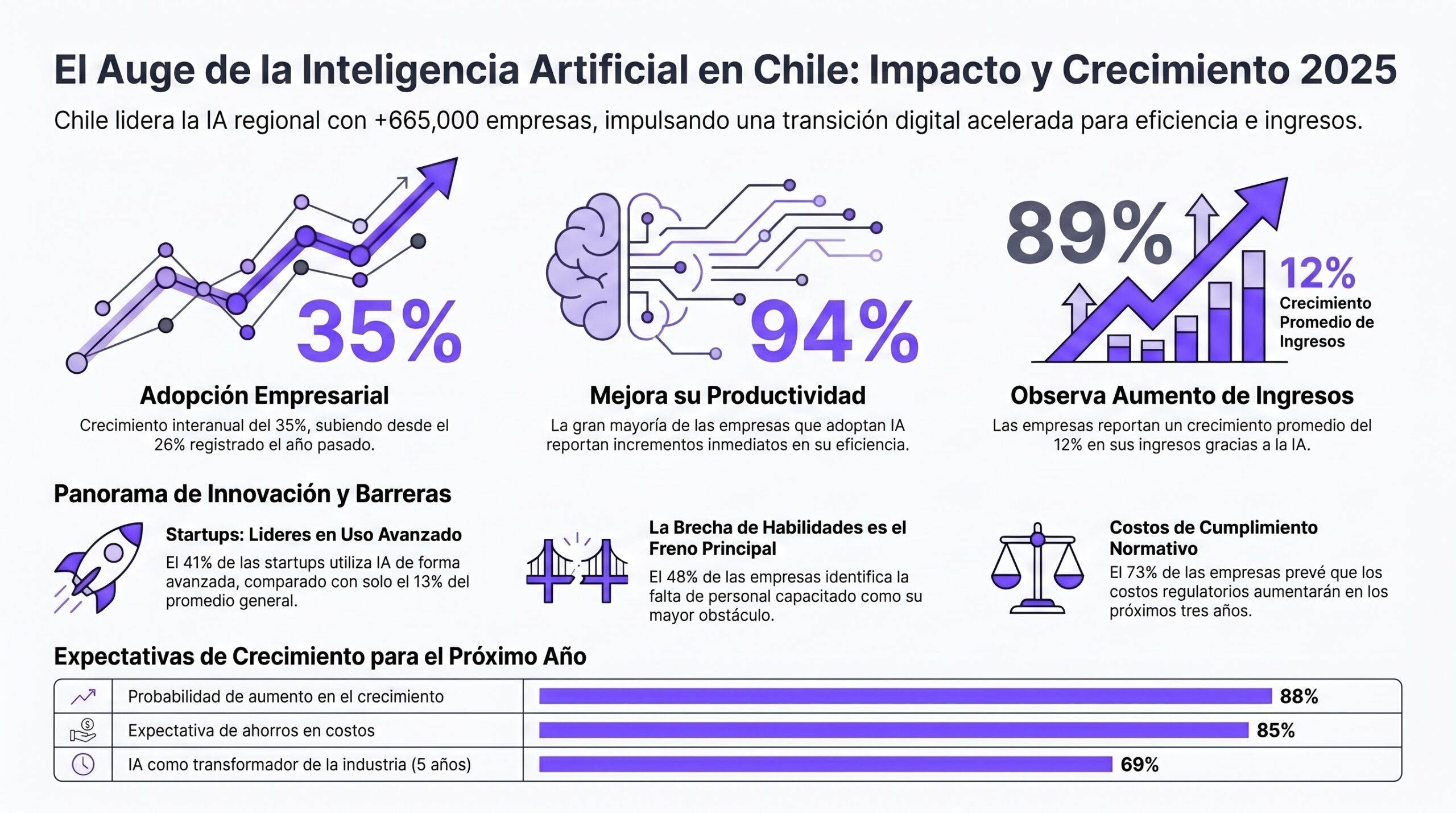

En Chile, el informe “Desbloqueando el Potencial de la IA en Chile” de Strand Partners indica una adopción de 35%, una mejora de productividad reportada por 94% de las empresas usuarias y un aumento de ingresos observado por 89%, con crecimiento promedio de 12%.

Tatha también destacó el caso de Approbe, donde una solución trabajada con AWS elevó la detección de fraude desde tasas cercanas al 70% a alrededor del 95%, mientras proyectos como Latam GPT muestran otra señal relevante, que es la búsqueda de modelos con contexto cultural y lingüístico propio de América Latina.

“Hoy ya no solo […] vemos pilotos, hay empresas que están generando impacto concreto en productividad, eficiencia e incluso ingresos gracias a la IA”.

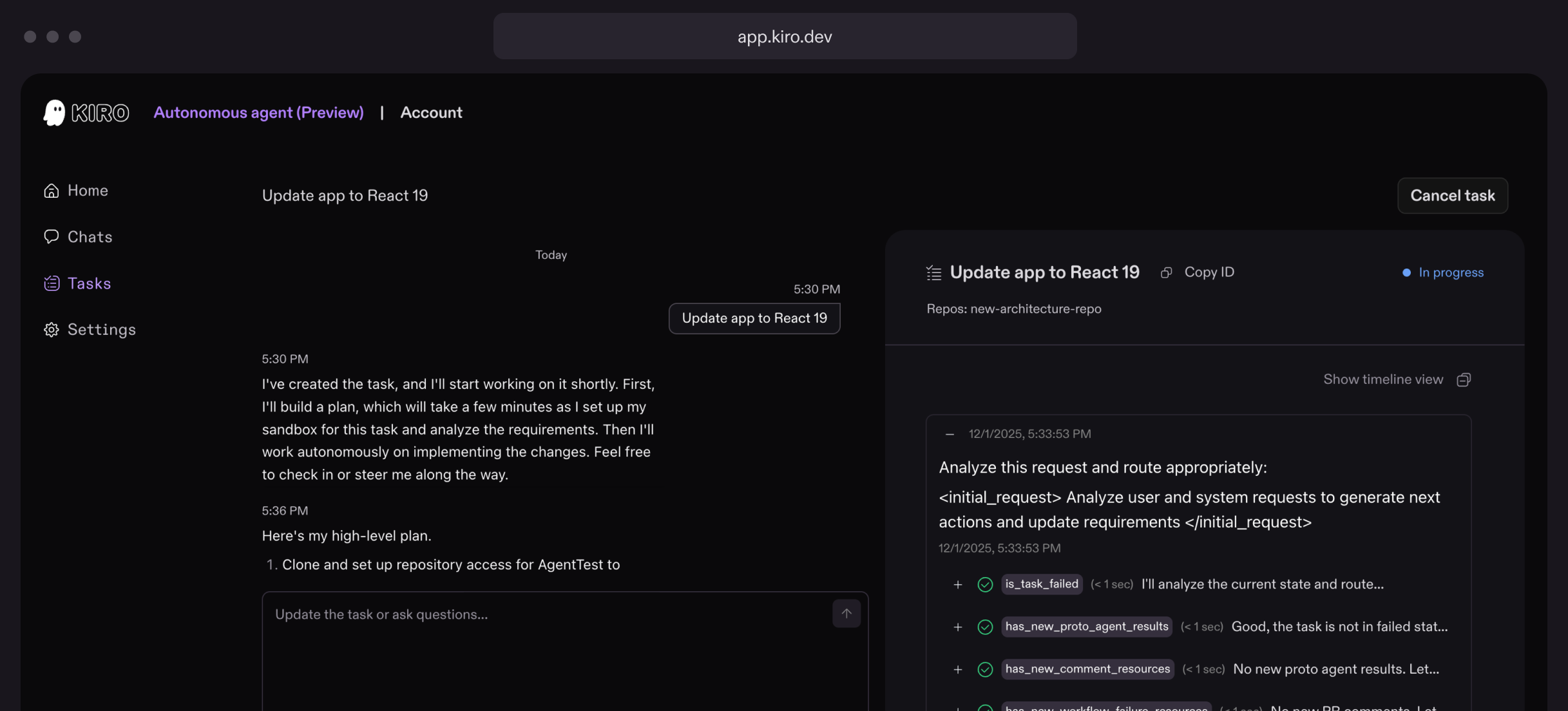

Ese paso desde la prueba al uso sostenido también empuja una conversación nueva, ligada a la llamada IA agéntica. Lo interesante aquí es que ya no se habla solo de asistentes conversacionales, sino de sistemas que se meten en el desarrollo, la seguridad y la operación cotidiana.

“2026 es el año de la IA agéntica. Hoy no solo estamos hablando de agentes, sino de agentes frontera […] El primero, centrado en el desarrollo de software (agente autónomo Kiro): el agente autónomo, aborda tareas de desarrollo full-stack, aprendiendo sobre tu proyecto mientras trabaja en segundo plano para mejorar continuamente. Ahora los desarrolladores tienen más tiempo ininterrumpido para trabajo de alta prioridad, en lugar de estar lidiando con tareas repetitivas”.

En esa misma línea, Tahta menciona un segundo agente enfocado en seguridad y un tercero orientado a operaciones. El primero apunta a crear aplicaciones seguras desde el inicio y el otro asume parte del trabajo operativo pesado, resolviendo y previniendo incidentes de manera proactiva mientras mejora confiabilidad y rendimiento.

“Un agente […] con un foco especial en seguridad (AWS Security Agent), ayuda a crear aplicaciones seguras desde el inicio […]. Y luego uno especializado en operaciones (AWS DevOps Agent), se encarga del trabajo operativo pesado, resolviendo y previniendo incidentes de manera proactiva […]. Está de turno cuando ocurren incidentes”.

Chile entra en escena con infraestructura local y ejecución más cercana

La conversación aterriza con fuerza en Chile cuando aparece la futura región local de AWS, esto de ser abstracto, porque entra en juego la posibilidad de ejecutar aplicaciones desde centros de datos en el país, con menor distancia operativa y con una base más cercana para desarrolladores, startups, empresas y organizaciones de distintos sectores.

“La futura región de AWS en Chile representa una oportunidad estructural para el desarrollo del ecosistema digital del país, al habilitar una mayor adopción de tecnologías avanzadas, mejorar la performance y acelerar la innovación local”.

En este contexto, Amazon planea invertir más de $4 mil millones en Chile durante los próximos 15 años para apoyar la construcción, conexión, operación y mantenimiento de sus centros de datos en el país, en una señal que sitúa la infraestructura como parte concreta del debate y no solo como telón de fondo.

“Esta región brindará a desarrolladores, startups, emprendedores y empresas […] una mayor capacidad de elección para ejecutar sus aplicaciones y atender a usuarios finales desde centros de datos ubicados en Chile”.

Claramente, la nube ya no necesita explicarse como hace dos décadas y la IA dejó de sostenerse solo en demostraciones, porque ahora la presión está en otra parte: hacerla útil, segura, estable y suficientemente real como para permanecer.